Hoe u Ollama installeert en gebruikt om grote taalmodellen (LLM's) op uw Windows 11-computer uit te voeren

Er zijn verschillende manieren om grote taalmodellen (LLM's) lokaal op uw Windows-computer uit te voeren, en Ollama is een van de eenvoudigste en meest efficiënte manieren.

De meest voorkomende interactie die de meesten van ons nu met AI hebben, is via cloudgebaseerde tools zoals ChatGPT أو CopilotOm deze hulpmiddelen te kunnen gebruiken, hebt u een internetverbinding nodig, maar het voordeel is wel dat u ze op vrijwel elk apparaat kunt gebruiken.

Maar niet iedereen, en zeker niet ontwikkelaars, wil voor AI-toepassingen vertrouwen op de cloud. Daarom wilt u dat uw grote taalmodel (LLM) lokaal op uw machine draait. Hier komt Ollama om de hoek kijken.

Ollama is een inferentietool waarmee je een breed scala aan grote taalmodellen (LLM's) native op je computer kunt uitvoeren. Het is niet de enige manier om dit te doen, maar het is wel een van de eenvoudigste en meest overzichtelijke. Met Ollama kun je de kracht van AI benutten zonder dat je een constante internetverbinding nodig hebt, waardoor je volledige controle hebt over je gegevens en privacy.

Zodra je aan de slag bent, kun je veel doen met Ollama en de grote taalmodellen (LLM's) die het gebruikt, maar de eerste stap is de installatie. Laten we je stap voor stap door dit proces leiden, zodat je deze krachtige tool optimaal kunt benutten.

Ollama-systeemvereisten

Het draaien van Ollama zelf verbruikt niet veel systeembronnen en kan op een breed scala aan apparaten worden uitgevoerd. Het is compatibel met Windows 11, macOS en Linux. Je kunt het zelfs gebruiken vanaf je Linux-distributies binnen Windows 11 via WSL.

Maar het uitvoeren van grote taalmodellen (LLM's) vereist zelf krachtigere hardware. Hoe groter het model, hoe meer rekenkracht je nodig hebt. Deze modellen vereisen een grafische verwerkingseenheid (GPU). Momenteel zijn ze niet geoptimaliseerd voor de neurale verwerkingseenheid (NPU) in de nieuwe Copilot+ pc's.

Gelukkig zijn er kleine modellen die je op bescheiden hardware kunt gebruiken. Zo heeft Google's Gemma 3-model een model met 1 miljard parameters dat slechts 2.3 GB visueel random access memory (VRAM) nodig heeft om het volledige model uit te voeren. Dit aantal loopt op tot meer dan 9 GB VRAM als je overstapt naar het model met 4 miljard parameters.

Hetzelfde geldt voor Meta's Llama 3.2, waar het model met 1 miljard parameters een GPU met slechts 4 GB VRAM vereist om succesvol te draaien. Dit neemt vervolgens toe tot 8 GB voor het model met 3 miljard parameters.

Kortom, als u over een relatief moderne computer met minimaal 8 GB RAM en een speciale GPU beschikt, kunt u waarschijnlijk wel wat voordeel halen uit Ollama.

Ollama-installatiehandleiding op Windows 11

Het installeren van Ollama op Windows 11 is een heel eenvoudig proces, dat wordt samengevat in het downloaden Installeer het programma vanaf de officiële website Of van GitHub-opslagplaatsen installeer het vervolgens op uw apparaat.

Dit zijn de eenvoudige stappen.

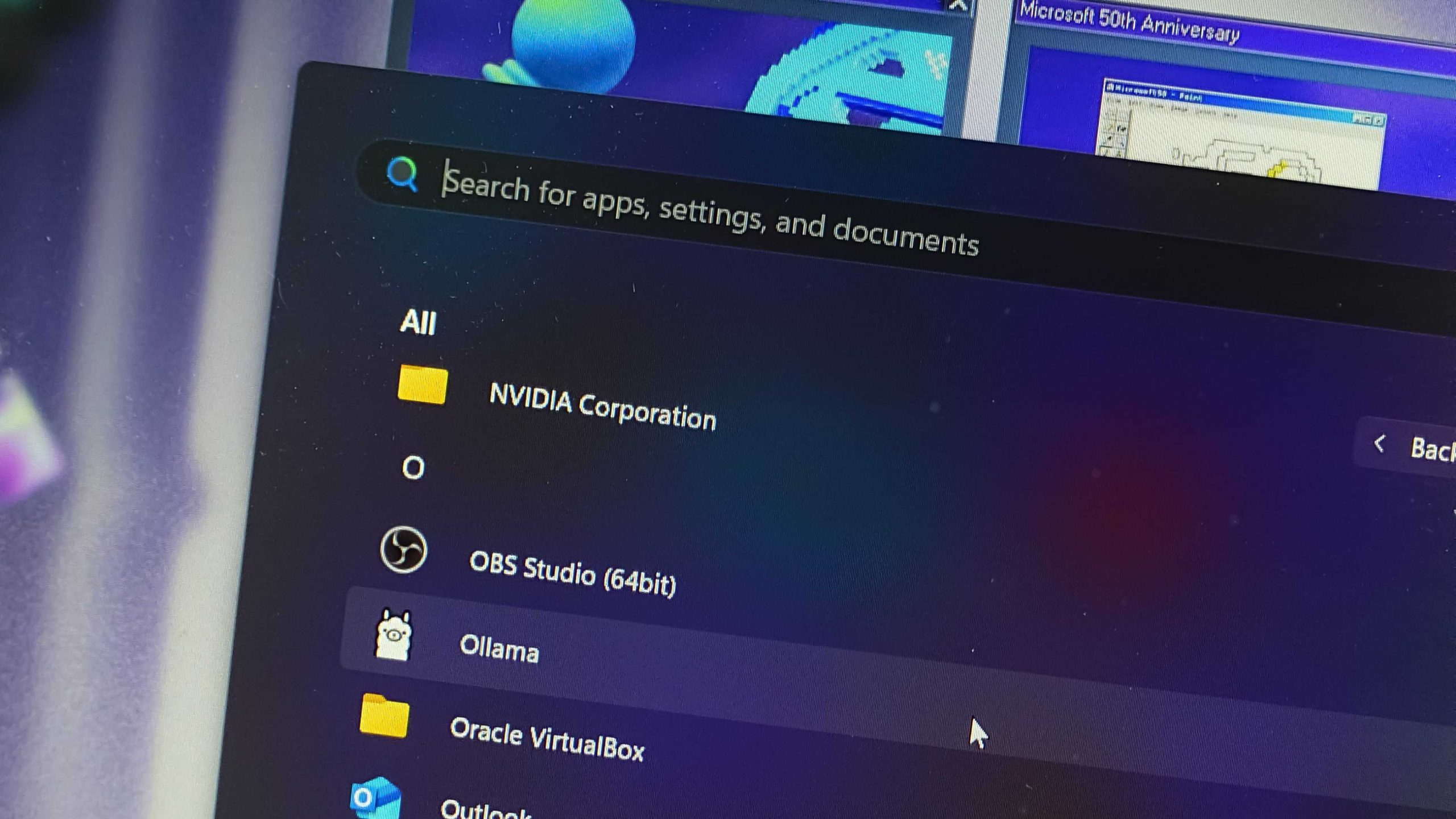

Na installatie en lancering verschijnt er niets op uw bureaublad. Het programma draait volledig op de achtergrond, maar u kunt het pictogram ervan wel zien in de taakbalk.

Om te controleren of het programma goed werkt, kunt u naar het adres gaan localhost: 11434 in uw webbrowser.

Installeer en voer uw eerste grote taalmodel (LLM) uit op Ollama

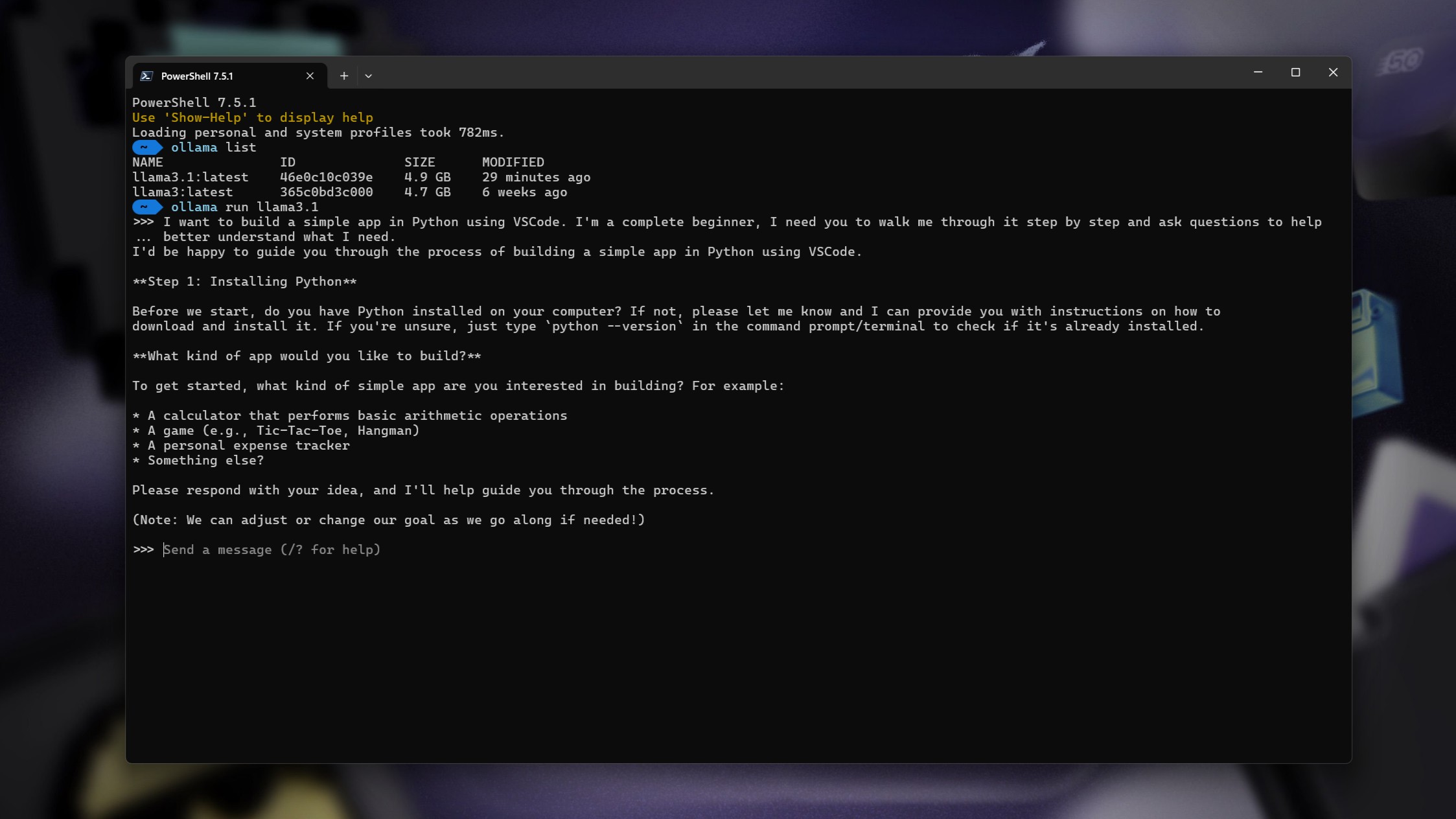

Om je eerste grote taalmodel (LLM) met Ollama uit te voeren, zul je voornamelijk de opdrachtregelinterface (CLI) moeten gebruiken. Open PowerShell op Windows of gebruik WSL als je Ollama daarop hebt geïnstalleerd.

Hoewel er grafische gebruikersinterfaces (GUI's) voor Ollama bestaan, concentreren we ons hier op het gebruik van de opdrachtregel. Het is handig als je vertrouwd bent met het gebruik van de CLI.

De twee belangrijkste dingen die u moet weten zijn:

loop

zet het

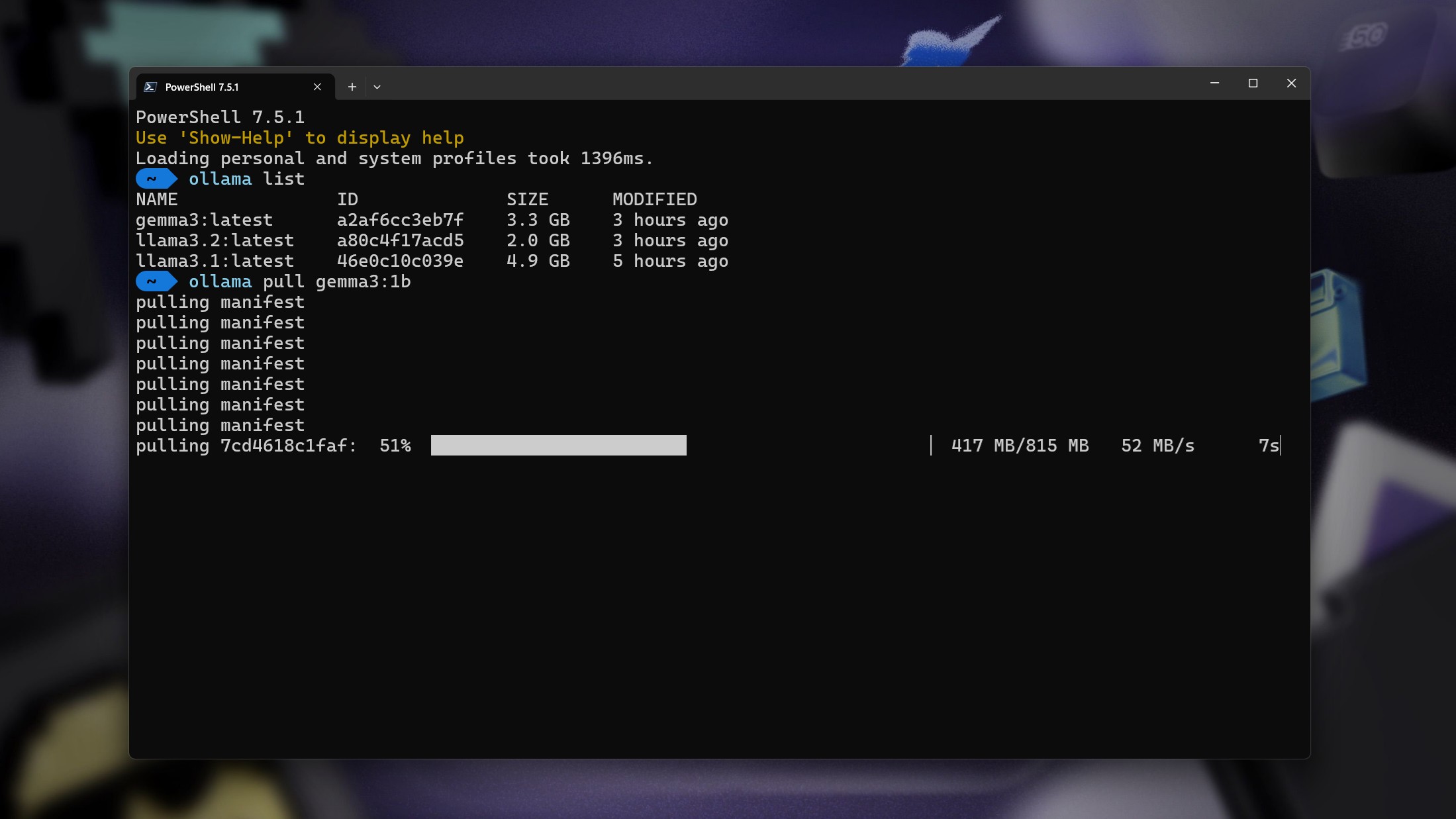

Als je Ollama vraagt om een LLM-model uit te voeren dat momenteel niet is geïnstalleerd, wordt het automatisch eerst gedownload en vervolgens uitgevoerd. Je kunt de juiste namen voor de grote taalmodellen die je wilt installeren eenvoudig vinden op Ollama-website.

Om bijvoorbeeld het Google Gemma 3 LLM-model met 1 miljard parameters te installeren en uit te voeren, voert u de volgende opdracht in:

ollama run Gemma:1b

Houd er rekening mee dat het toevoegen van :1b Geef na de naam aan dat u het model met 1 miljard parameters wilt. Als u het model met 4 miljard parameters wilt, wijzigt u dit in **:4b**.

Als u formulieren op uw terminal uitvoert, wordt een vertrouwde chatbot-ervaring geopend, waarin u uw vragen kunt schrijven en reacties kunt ontvangen. Dit alles wordt lokaal op uw apparaat uitgevoerd.

Om het formulier te verlaten en terug te keren naar PowerShell, typt u eenvoudig **/bye**. Het proces wordt dan beëindigd.

Dit behandelt de absolute basisprincipes voor het installeren van Ollama op je computer, zodat je de beschikbare LLM's kunt gebruiken. De basiservaring is heel eenvoudig en gebruiksvriendelijk, en vereist vrijwel geen technische kennis. Als ik het kan, kun jij het ook!

Reacties zijn gesloten.