De risico's van AI voor bedrijven: alternatieven voor OpenAI en de instellingen achter AI-agenten

Gegevensprivacy, naleving en vertrouwenslacunes in huidige AI-agentintegraties

“Wacht… stuur je je grootboekposten naar OpenAI?”

Dat was het eerste wat mijn vriendin vroeg toen ik het haar liet zien. Voel-Schrijf, een AI-gestuurde dagboek-app die ik tijdens een hackathon in San Francisco heb gebouwd.

Ik haalde mijn schouders op.

“Het was een hackathon met een AI-thema, en ik moest snel iets bouwen.”

Ze miste geen moment:

"Tuurlijk. Maar hoe kan ik vertrouwen op wat ik heb opgebouwd? Waarom organiseer je niet gewoon je eigen LLM?"

Dat hield mij tegen.

Ik was trots op hoe snel de app in elkaar was gezet. Maar deze ene vraag, en de vragen die erop volgden, onthulden alles wat ik dacht te weten over verantwoord bouwen met AI. Ook de jury van de hackathon had er aandacht voor.

Dat moment deed me beseffen hoe respectloos we zijn als we met AI bouwen, vooral met tools die gevoelige gegevens verwerken.

Ik realiseerde me iets groters:

Er wordt te weinig over vertrouwen gesproken als we met AI bouwen.

Haar antwoord bleef bij mij hangen. Georgia von Minden is datawetenschapper bij de ACLU, waar zij nauw samenwerkt met vraagstukken rondom persoonlijk identificeerbare informatie in de juridische en burgerrechtencontext. Ik heb haar inzicht altijd gewaardeerd, maar dit gesprek was anders.

Dus vroeg ik haar om uitleg. Wat betekent vertrouwen in deze context eigenlijk? Vooral wanneer AI-systemen met persoonsgegevens omgaan.

Ze vertelde mij:

Vertrouwen opbouwen kan lastig zijn, maar data governance is een goed beginpunt. Wie de eigenaar van de data is, hoe deze wordt opgeslagen en waarvoor deze wordt gebruikt, is allemaal belangrijk. Tien jaar geleden zou ik deze vraag anders hebben beantwoord. Maar vandaag de dag, met de enorme rekenkracht en enorme dataopslag, is brede inferentie een reële zorg. OpenAI heeft zo'n uitgebreide toegang tot zowel computers als data dat het gebrek aan transparantie voorzichtigheid oproept.

Als het gaat om persoonlijk identificeerbare informatie (PII), wijzen zowel regelgeving als gezond verstand op de noodzaak van sterk databeheer. Het versturen van persoonlijk identificeerbare informatie in API-aanroepen is niet alleen riskant, het kan ook in strijd zijn met deze regels en individuen in gevaar brengen.

Het deed me beseffen dat wanneer we met AI bouwen, vooral systemen die gevoelige menselijke gegevens verwerken, we niet alleen maar code schrijven.

Wij nemen beslissingen over privacy, autoriteit en vertrouwen.

Op het moment dat u gebruikersgegevens verzamelt, vooral persoonlijke gegevens zoals dagboeknotities, neemt u een verantwoordelijkheidsgevoel aan. Het gaat niet alleen om wat uw model kan. Het gaat erom wat er met die gegevens gebeurt, waar ze naartoe gaan en wie er toegang toe heeft. Verantwoord omgaan met gebruikersgegevens vergroot het vertrouwen van de gebruiker en verbetert de privacy.

De illusie van eenvoud

Tegenwoordig is het makkelijker dan ooit om iets te lanceren dat er slim uitziet. Met grote taalmodellen (LLM's) zoals OpenAI en andere kunnen ontwikkelaars binnen enkele uren AI-tools bouwen. Startups kunnen binnen een dag ‘AI-aangedreven’ functies lanceren. Hoe zit het met instellingen? Er wordt haast gemaakt met het integreren van deze agenten in de workflow.

Maar in al deze opwinding wordt één ding vaak over het hoofd gezien: Vertrouwen.

Als mensen praten over AI-agentenVaak verwijzen ze naar eenvoudige wrappers rond grote taalmodellen (LLM's). Deze agenten kunnen vragen beantwoorden, taken automatiseren en zelfs beslissingen nemen. Maar veel ervan zijn overhaast gebouwd, met weinig aandacht voor beveiliging, naleving van regels en verantwoording.

Gebruik het product alleen voor OpenAI Dat betekent niet dat het veilig is. Waar je echt op vertrouwt is de gehele pijplijn:

- Wie heeft de cover gemaakt?

- Hoe worden uw gegevens verwerkt?

- Wordt uw informatie opgeslagen, geregistreerd of, erger nog, gelekt?

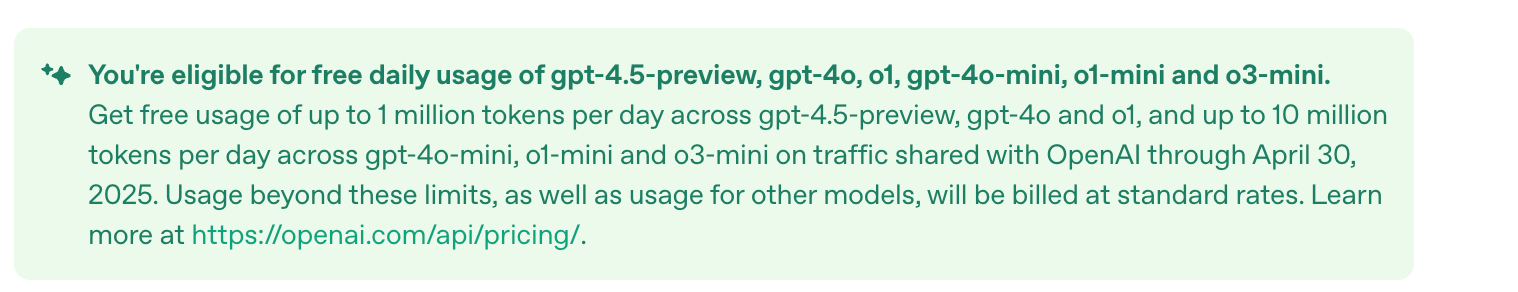

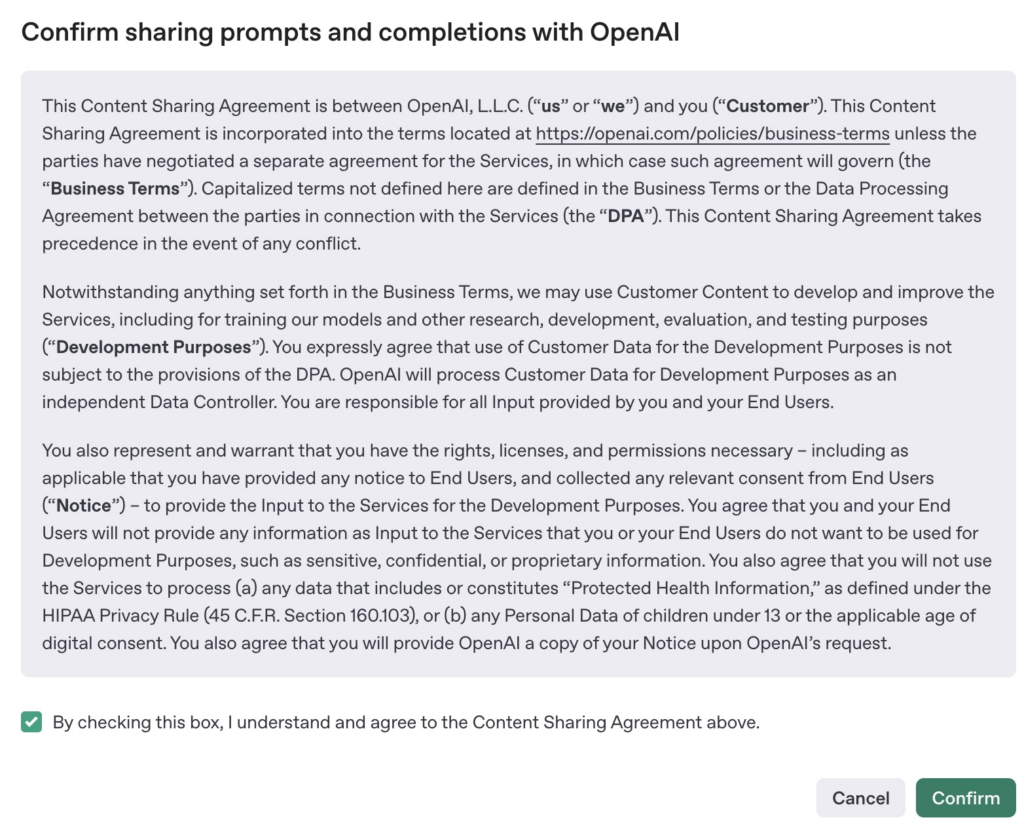

Ik heb de API van OpenAI zelf voor klantcases gebruikt. Onlangs werd mij gratis toegang tot de API aangeboden – tot 1 miljoen tokens per dag tot eind april – Als ik akkoord ga met het delen van mijn claimgegevens.

Ik stond op het punt om hiermee akkoord te gaan voor een persoonlijk zijproject, maar toen realiseerde ik me: als een oplossingsleverancier hetzelfde aanbod zou doen om kosten te besparen, zouden hun gebruikers geen idee hebben dat hun gegevens werden gedeeld. Op persoonlijk vlak lijkt dit misschien onschuldig. Maar binnen de context van de instelling? Dit is een ernstige schending van de privacy en mogelijk ook van contractuele of wettelijke verplichtingen.

Het is maar één ingenieur nodig die 'ja' zegt tegen een deal als deze, en uw klantgegevens zijn in de handen van iemand anders.

Enterprise AI verhoogt verwachtingen

Ik zie steeds meer SaaS-bedrijven en startups in ontwikkeltools experimenteren met AI-agents. Sommige laten goede resultaten zien, waarbij sommige AI-agents gebruikers in staat stellen hun eigen grote taalmodellen (LLM's) in te brengen, waardoor ze controle hebben over waar het model draait en hoe de data wordt verwerkt. Dit is een verstandige aanpak, vooral nu AI steeds belangrijker wordt binnen bedrijven.

Dit is de doordachte aanpak: U bepaalt de vertrouwensgrenzen..

Maar niet iedereen is er zo enthousiast over.

Veel bedrijven maken simpelweg verbinding met de API van OpenAI, voegen een paar knoppen toe en noemen het 'enterprise ready'.

Waarschuwing: Dit is niet waar.

Wat kan er misgaan? veel.

Als u AI-agenten in uw infrastructuur integreert zonder de moeilijke vragen te stellen, zijn dit de potentiële risico's:

- DatalekUw claims kunnen gevoelige klantgegevens, API-sleutels of interne logica bevatten. Als u deze via een formulier van derden indient, kunnen deze worden blootgesteld.

In 2023 hebben Samsung-technici onbedoeld interne broncode en notities in ChatGPT geplakt (Forbes). Deze gegevens kunnen nu deel uitmaken van toekomstige trainingssets, wat een aanzienlijk risico vormt voor intellectueel eigendom.

- Overtredingen van de nalevingHet indienen van persoonlijk identificeerbare informatie (PII) via een formulier als OpenAI zonder de juiste controles kan een schending van de Algemene Verordening Gegevensbescherming (AVG), HIPAA of uw contracten inhouden.

Het bedrijf van Elon Musk, X, heeft dit op de harde manier moeten leren. Ze lanceerden hun AI-chatbot, "Grok", en gebruikten alle berichten van gebruikers, inclusief die van EU-gebruikers, om hem te trainen, zonder het juiste abonnement. De organisatoren kwamen snel in actie. Onder druk stopten ze met de opleiding van Grok in de Europese Unie (Polityczno).

- vaag gedragNiet-deterministische agenten zijn moeilijk te corrigeren of te verklaren. Wat gebeurt er als een klant vraagt waarom een chatbot een verkeerde aanbeveling heeft gedaan of iets vertrouwelijks heeft onthuld? Om die vraag te kunnen beantwoorden, is transparantie nodig. Veel makelaars bieden dat vandaag de dag niet.

- Verwarring over data-eigendomWie is de eigenaar van het product? Wie registreert de gegevens? Wordt er door de dienstverlener bijgeschoold op basis van uw input?

Zoom werd in 2023 betrapt op precies dat soort praktijken. Ze veranderden in stilte hun servicevoorwaarden om het gebruik van gegevens van klantvergaderingen toe te staan om AI te trainen (Fast Company). Na de publieke verontwaardiging werd het beleid teruggedraaid, maar het herinnerde ons eraan dat vertrouwen zomaar van de ene op de andere dag verloren kan gaan.

- Beveiligingslekken in de verpakkingIn 2024 bleken tientallen implementaties van Flowise – een populaire low-code LLM-orkestratietool – blootgesteld aan het internet, veel zonder authenticatie (Cybersecurity-nieuws). Onderzoekers ontdekten dat API-sleutels, database-inloggegevens en gebruikersgegevens openbaar zijn. Dit is niet het probleem van OpenAI - dit is een probleem. Bouwers. Maar de eindgebruiker betaalt nog steeds de prijs.

- AI-functies die te ver gaanDe 'Recall'-functie van Microsoft, onderdeel van hun Copilot-uitrol, maakte automatisch screenshots van de activiteit van gebruikers om de AI-assistent te helpen vragen te beantwoorden (DubbelePulsar). Het leek nuttig... totdat veiligheidsexperts het als een privacynachtmerrie bestempelden. Microsoft moest snel terugkrabbelen en de functie optioneel maken.

Niet alles heeft OpenAI nodig.

OpenAI is een ongelooflijk krachtig platform. Maar het is niet altijd de beste oplossing.

Soms is een kleiner lokaal model voldoende. Soms werkt regelgebaseerde logica beter. De veiligste optie is vaak een optie die volledig binnen uw eigen infrastructuur en volgens uw eigen regels functioneert.

We moeten niet klakkeloos een groot taalmodel (LLM) invoeren en het een 'intelligente assistent' noemen.

In instellingen, Vertrouwen, transparantie en controle zijn geen optionele extra's. - Het is eerder essentieel.

Er zijn steeds meer platforms die dit soort controle mogelijk maken. Einstein 1 Studio van Salesforce ondersteunt nu de functie breng-je-eigen-modelwaarmee u uw grote taalmodel (LLM) kunt verbinden vanuit AWS of Azure. Met IBM Watson kunnen organisaties modellen intern implementeren met volledige audit trails. Met MosaicML kunt u met Databricks privé-LLM's (Large Language Models) in uw eigen cloud trainen, zodat uw gevoelige gegevens uw infrastructuur nooit verlaten.

Zo zou echte AI voor bedrijven eruit moeten zien.

Conclusie

AI-agenten zijn ongelooflijk krachtig en maken workflows en automatisering mogelijk die we voorheen niet konden realiseren. Maar gemak bij de ontwikkeling betekent niet per definitie dat het ook veilig is, vooral niet als het gaat om gevoelige gegevens op grote schaal.

Voordat u dit fonkelnieuwe middel gaat gebruiken, moet u zichzelf het volgende afvragen:

- Wie beheert het model?

- Waar gaan de gegevens naartoe?

- Voldoen wij aan de regelgeving?

- Kunnen we controleren wat hij doet?

In het tijdperk van kunstmatige intelligentie is de grootste bedreiging niet slechte technologie, maar Blind vertrouwen.

Over de auteur

Ik ben Ellen, een machine learning engineer met 6 jaar ervaring. Momenteel werk ik bij een fintech-startup in San Francisco. Mijn achtergrond omvat functies in de datawetenschap bij consultancybureaus op het gebied van olie en gas, en het leiden van AI- en datatrainingsprogramma's in de regio Azië-Pacific, het Midden-Oosten en Europa.

Momenteel rond ik mijn masteropleiding Data Science af (ik studeer af in mei 2025) en ben actief op zoek naar mijn volgende kans als Machine Learning Engineer. Als u openstaat voor een doorverwijzing of connectie, zou ik dat zeer op prijs stellen!

Ik vind het geweldig om met behulp van AI een echte impact op de wereld te hebben en sta altijd open voor samenwerkingen op projectbasis.

Reacties zijn gesloten.