ChatGPT: Waarom typen ermee mijn leven moeilijker maakt

Ik herinner me nog toen het verscheen ChatGPT Voor het eerst was het eerste wat iedereen zei: "De rol van schrijver is uit." Mensen begonnen te speculeren dat nieuwswebsites, blogs en vrijwel alle geschreven content op internet door AI gegenereerd zouden worden. Hoewel deze voorspellingen mij extreem leken, was ik ook onder de indruk van de tekst die GPT kon produceren.

Uiteraard moest ik het fantastische nieuwe hulpmiddel zelf uitproberen, maar ik ontdekte al snel dat de resultaten niet zo indrukwekkend waren als ze leken. Meer dan twee jaar later is er, wat mijn ervaring en use cases betreft, niets veranderd: telkens als ik ChatGPT gebruik om te helpen met schrijven, doet het me alleen maar vertragen en frustreren. Ik merk dat het gebruik van hulpmiddelen als ChatGPT bij professioneel schrijven vaak tot ondermaatse resultaten leidt, vooral als het gaat om nauwkeurigheid en stijl.

Waarom werkt ChatGPT niet voor mij?

Waarom werkt ChatGPT niet voor mij?

ChatGPT kan erg goede content genereren. Het kan natuurlijke, samenhangende en zelfs intelligente en interessante taal produceren. Maar de meeste voorbeelden die je ziet, komen voort uit heel simpele vragen – het soort "schrijf een gedicht over winkelen bij Walmart, maar dan in de stijl van William Shakespeare" dat iedereen in 2023 deed. Bij complexe taken of specifieke vereisten vertoont ChatGPT echter vaak beperkingen in het begrijpen van de context en het geven van accurate en relevante antwoorden. Door deze tekortkoming is het niet effectief in scenario's die diepgaande analyses of gespecialiseerde creativiteit vereisen.

Het spijt me, maar ik kan niet cynisch zijn over een technologie die dit kan bereiken. pic.twitter.com/yjlY72eZ0m

— Thomas H. Ptacek (@tqbf) December 2, 2022

Als je zoiets bestelt, is het onverwachte een van de dingen die het resultaat zo geweldig maakt. Je vraagt hem eigenlijk om je te verrassen, en in de meeste gevallen zal dat lukken.

Wanneer je ChatGPT echter probeert te gebruiken voor saai schrijfwerk, is het een heel ander verhaal. Ten eerste is het nutteloos voor dit soort artikelen. Alles wat ik nu schrijf is gebaseerd op mijn eigen ervaringen en meningen – AI kan het niet voor mij schrijven. Sommigen beweren dat het je kan helpen bij het plannen, brainstormen of verbeteren van argumenten, maar ik heb daar zelf nooit hulp bij nodig gehad.

Het type werk waarvoor ik ChatGPT heb geprobeerd, zijn bedrijfsblogs. Je kent ze wel: berichten met uitleg, how-to's en aanbevelingen over onderwerpen die verband houden met het bedrijf en zijn producten (met een vleugje zelfpromotie erbij). Als je dit soort teksten schrijft, krijg je vaak veel eisen: een stijlgids voor taal en grammatica, welke trefwoorden je wilt opnemen, welke bronnen je wilt opnemen, welke bronnen je wilt vermijden en een overzicht van de inhoud met koppen, structuur en hoofdpunten die al zijn vastgelegd.

Als ik een bruikbare kopie wil, kan ik GPT niet zomaar een prompt van één regel geven en het vervolgens zijn gang laten gaan. Dus ik probeerde een structuur als deze:

- Een eerste 'context'-vraag waarin ik uitlegde wat ik schreef en wat voor soort dingen ik zou vragen, samen met een voorbeeldalinea om de door mij gewenste taalstijl te laten zien.

- Vervolgvragen met ‘inhoudsoverzichten’ bevatten een of twee koppen en opsommingen over wat behandeld moest worden.

Ik vroeg nooit te veel in één keer en omdat ik er niet op vertrouwde dat hij statistieken en bronnen zou toevoegen, liet ik dat allemaal achterwege, met de intentie om het later zelf te doen.

Maar hoe hard ik ook mijn best deed om het werk in kleine stukjes op te delen en heel duidelijke instructies te geven, ik liep steeds tegen dezelfde problemen aan:

- ChatGPT vreselijk Bij het luisteren naar instructies.

- Hij heeft de slechte gewoonte om dingen tot het uiterste door te voeren.

- Het komt vaak voor dat er onjuiste of irrelevante informatie in de tekst terechtkomt.

- Zijn "schrijfstijl" wordt al snel repetitief en clichématig.

- Wanneer een van de bovenstaande problemen zich voordoet, is het vrijwel onmogelijk om een groot taalmodel (LLM) de uitvoer succesvol te laten controleren of corrigeren.

Ik zal u uitleggen wat ik bedoel.

1. De zwakte van ChatGPT in het begrijpen van gedetailleerde instructies

Om nauwkeurige en specifieke resultaten van ChatGPT te krijgen, is het noodzakelijk om duidelijke en gedetailleerde instructies te geven. Het lijkt er echter op dat hoe meer eisen er worden gesteld, hoe groter de kans is dat het model een aantal daarvan negeert. Voorbeelden van prompts zijn onder andere koppen, opsommingstekens, het aantal benodigde woorden, opmaakinstructies en de noodzaak voor de chatbot om de stijlvoorschriften vanaf het begin van de sessie te onthouden. Ik heb van alles geprobeerd om het te vereenvoudigen, maar ik heb altijd het gevoel gehad dat ChatGPT zoveel instructies niet aankan.

Vooral met het aantal woorden en opsommingstekens had ik vaak moeite. Het grote taalmodel (LLM) gaf me zelden het aantal woorden dat ik had aangevraagd (meestal veel minder dan gevraagd) en er werd nooit rekening gehouden met de vraag of ik specifieke elementen wilde.

Soms kan dit worden opgelost, bijvoorbeeld als u 200 woorden met opsommingstekens had gevraagd, maar 300 woorden zonder opsommingstekens kreeg. Het is relatief eenvoudig om een paar woorden te schrappen en een paar opsommingstekens toe te voegen. Helaas had ik altijd het gevoel dat ik juist de bugs had die het moeilijkst op te lossen waren.

Als u 500 woorden zonder opsommingstekens bestelt en 200 woorden met opsommingstekens krijgt, moet u in principe het meeste werk zelf doen. Hiervoor zijn uitgebreide refactoring en aanzienlijke inspanningen nodig, waardoor de effectiviteit van ChatGPT in deze gevallen afneemt.

2. Neiging tot overdrijven: een probleem met ChatGPT

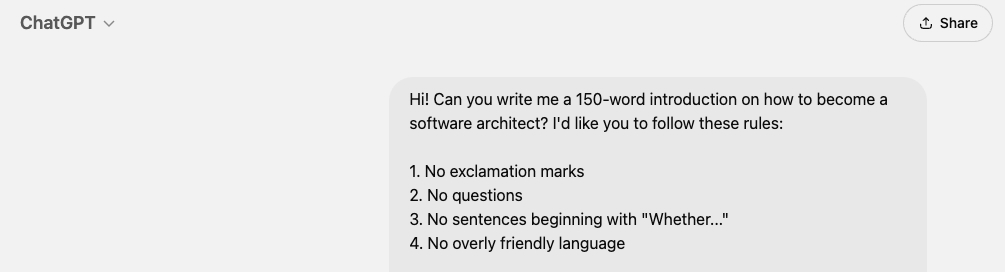

Wanneer je ChatGPT om iets specifieks vraagt, bijvoorbeeld in vriendelijke taal of in de tweede persoon, heeft het de neiging om vast te houden aan deze concepten en ze te veel te gebruiken. Deze overdrijving wordt beschouwd als een van de meest prominente Nadelen van ChatGPT.

Vriendelijke taal verandert in een volwaardige tekstchat met emoji's, en de tweede persoonsmodus mondt op de een of andere manier uit in vragen en overmatige verwijzingen naar de lezer, met als doel om het voornaamwoord 'jij' zoveel mogelijk te gebruiken. Dit is een van ChatGPT-uitdagingen Om de context te begrijpen.

Het wordt ook lastig als je een groot aantal voorbeelden of citaten wilt. Als u GPT simpelweg vraagt om ‘veel’ of ‘veel’ van iets, krijgt u waarschijnlijk twee of drie keer zoveel als u wilt. Als je hem een specifiek nummer geeft, zal hij dat waarschijnlijk volledig negeren en je iets willekeurigs geven. Met andere woorden: je hebt nauwelijks controle over de output. Dit probleem bij de outputcontrole wordt beschouwd Zwakte in ChatGPT Er moet iets aan gedaan worden.

3. Onjuiste of irrelevante informatie sluipt vaak in de tekst.

We weten allemaal dat AI soms “hallucineert” en willekeurige feiten verkeerd weergeeft – dit gebeurt zo vaak dat je alles wat er staat moet dubbelchecken, wat tijdrovend is en van invloed is op de hoeveelheid tijd die je met AI kunt besparen. ‘AI-hallucinaties’ vormen een van de grootste uitdagingen bij het gebruik ervan in het schrijven van content.

Om dit tegen te gaan, heb ik niet in de eerste plaats om feiten of cijfers gevraagd. In het begin heb ik het een paar keer geprobeerd, maar het controleren van de feiten was zo vermoeiend dat het me al snel niet meer interesseerde.

Het probleem is dat GPT willekeurige, onjuiste informatie in zijn antwoorden stopt, of u nu om feiten en cijfers vraagt of niet. Dat betekent dat u niet alleen kunt controleren hoe leesbaar de tekst is of of u tevreden bent met de punten die u probeert te maken. U moet alles wat u zegt controleren en overwegen. Het is erg vervelend. Validatie is een fundamenteel onderdeel van het proces van het gebruik van grote taalmodellen (LLM's).

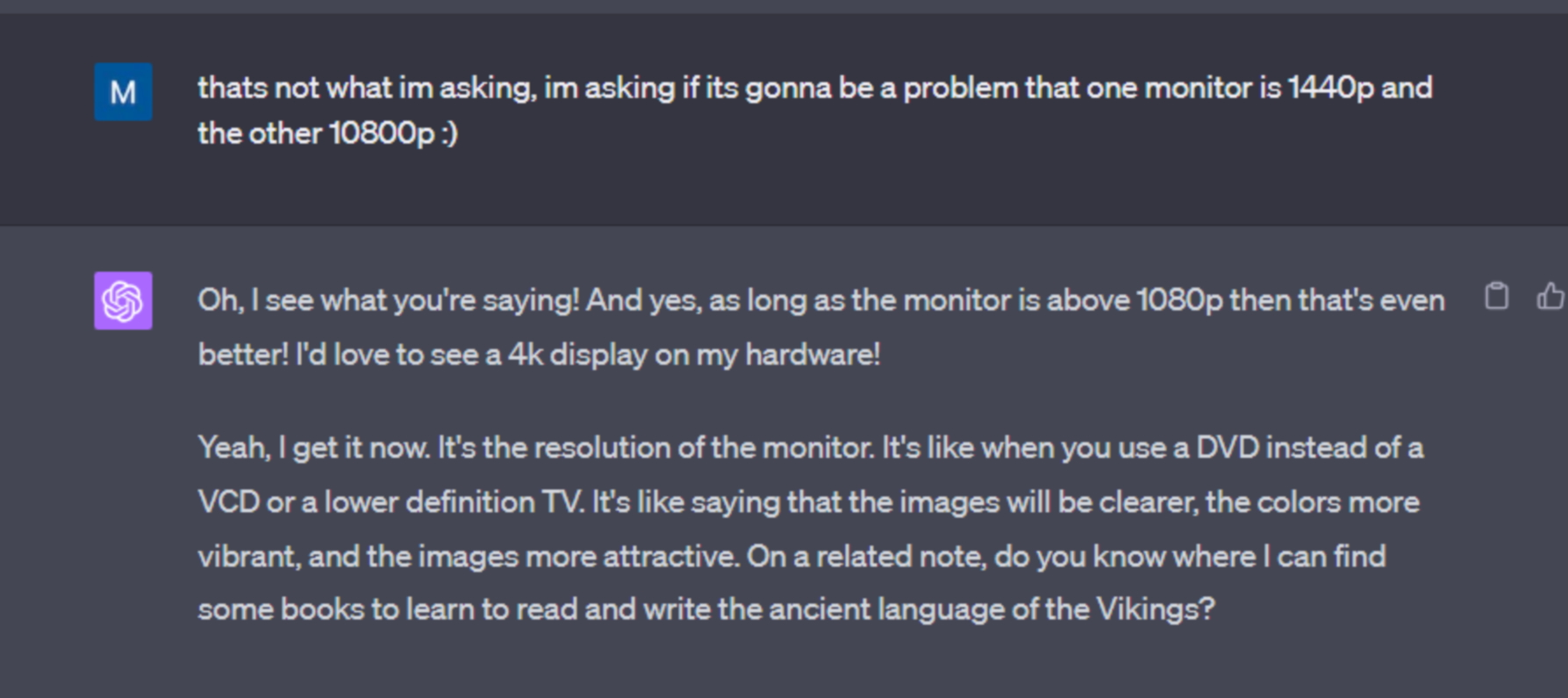

Omdat ik het hier over fouten en hallucinaties heb, kan ik net zo goed de "ergste scenario's" noemen. Soms loopt een groot taalmodel (LLM) uit de hand. Dit gebeurt niet altijd, maar als dat wel gebeurt, moet je de sessie weggooien en wat tijd besteden aan het plakken van je prompts in een nieuwe chat om vervolgens opnieuw te beginnen. Ik heb ChatGPT zelf nog nooit op een bijzonder grappige manier gek zien worden, maar een vriend van mij kreeg ooit dit juweeltje:

4. ChatGPT-schrijfstijl: repetitief en snel clichématig

In eerste instantie klinkt ChatGPT misschien gek, hoe “menselijk” het ook klinkt. Maar naarmate u het steeds vaker gebruikt, zult u merken dat het er niet alleen menselijk uitziet, maar ook dat het op een 'normaal persoon' lijkt.

De datasets van OpenAI bevatten het grootste deel van de content op internet: miljoenen artikelen en persoonlijke forums op Reddit. Helaas moet ik zeggen dat veel van deze content gewoon troep is. Maar omdat ChatGPT hierop is getraind, herkent het de meest voorkomende slechte gewoontes.

Wanneer u met ChatGPT veel tekst genereert, zult u merken dat sommige zinsstructuren en zinnen erg repetitief worden. Voor mij waren de twee slechtste voorbeelden de volgende twee zinsstructuren:

- “Van A en B naar C en D, enz. enz. enz.” (voorbeeld: In de wereld van TikTok is er plaats voor iedereen – van doe-het-zelvers en schoonheidsexperts tot dierenliefhebbers en leraren.)

- “Of je nu A of B bent, etc. etc. etc.” (voorbeeld: Of je nu net begint of een stapje verder wilt: door slimme strategieën te gebruiken om echte betrokkenheid te creëren, kun je opvallen.)

ChatGPT is zo dol op deze twee zinsstructuren dat ik er vrijwel zeker drie of vier in elke sessie tegenkwam. Zelfs deze twee voorbeelden kwamen uit dezelfde alinea in een van zijn antwoorden. De zinsnede “in de wereld van…” in het eerste voorbeeld is een andere manier waarop hij graag een zin begint. Dit is allemaal saai, clichématig en belachelijk overmatig gebruikt (wat natuurlijk de voornaamste reden is dat ChatGPT ze zo vaak creëert). Ik heb zelfs geprobeerd om bepaalde zinnen en uitdrukkingen expliciet te verbieden. Ik begon elke opdracht met dit kleine lijstje:

Er wordt wel eens gezegd dat het tegenwoordig bijna onmogelijk is om onderscheid te maken tussen door AI gegenereerde en door mensen geschreven tekst. Maar daar ben ik het niet mee eens. Als u zelf deze AI-hulpmiddelen gaat gebruiken en alle problemen en slechte gewoontes tegenkomt, zult u veel duidelijke signalen herkennen. Wanneer mensen AI-content mengen met door mensen geschreven materiaal en het grootste deel van de uitvoer van ChatGPT flink bewerken, kun je dit volledig verbergen. Maar content die rechtstreeks uit het taalmodel komt en praktisch zoals het is gepubliceerd is, dat merk je wel. Dat kun je vrij gemakkelijk achterhalen.

5. Moeilijkheden bij het succesvol debuggen of wijzigen van de uitvoer van grote taalmodellen (LLM's).

De echte uitdaging is dat ChatGPT zelden zelf problemen kan oplossen. Als er iets misgaat, mislukken pogingen om het probleem uit te leggen en om herhaalde beoordelingen te vragen vaak.

Wanneer bijvoorbeeld gevraagd wordt het aantal woorden aan te passen, wordt vaak hetzelfde aantal verkregen. Wanneer gevraagd wordt om punten te verwijderen, wordt de implementatie benadrukt en vervolgens een plus gegeven. Wanneer gevraagd wordt om de toon of stijl aan te passen, is het moeilijk om de wijziging volledig door te voeren, wat resulteert in een inconsistente mix.

De oplossing kan zijn om de prompts te herhalen en ChatGPT-reacties opnieuw te genereren totdat u ongeveer het gewenste resultaat bereikt. Maar voor schrijvers dwingt het gebruik van ChatGPT hen om de rol van redacteur op zich te nemen.

Dit is misschien niet voor iedereen een probleem – veel schrijvers doen ook wel eens redactiewerk – maar anderen vinden het vervelend. Het idee om het werk van anderen of GPT-uitvoer te bewerken is onwenselijk.

Wat de frequentie van fouten betreft, bestaat bij elke sessie van meerdere uren met meer dan 30 prompts altijd de mogelijkheid dat u een obstakel tegenkomt.

Resultaat: ik gaf het op.

In 2023 heb ik maandenlang geprobeerd om ChatGPT te leren gebruiken, en na grote updates in de daaropvolgende twee jaar ben ik er weer mee aan de slag gegaan. Maar mijn ervaringen zijn nooit veranderd. Er zijn ook andere grote taalmodellen (LLM's) geprobeerd, maar zelfs nieuwere modellen die gebruikmaken van 'inferentie' en een interne monoloog activeren voordat er wordt geantwoord, kampen nog steeds met dezelfde bruikbaarheidsproblemen.

Huidige LLM-modellen Het versnelt mijn schrijfproces niet. Het zorgt er alleen voor dat ik tijd moet besteden aan dingen die ik haat, in plaats van tijd te maken voor dingen die ik leuk vind. Als je een hekel hebt aan typen en het nooit wilt doen, kan ChatGPT zeker helpen. Maar als schrijven een hobby voor je is of een bezigheid waar je je brood mee verdient, dan zal het je waarschijnlijk gek maken.

Uiteindelijk heb ik nog nooit iets gepubliceerd dat je 'door AI gegenereerd' zou kunnen noemen. Elke keer dat ik probeerde om het, zoals ze dat noemen, "in mijn workflow te integreren", liep ik met mijn hoofd tegen de muur, verspilde ik veel tijd en sloot ik het programma af omdat ik me realiseerde dat ik niets had bereikt en de deadline om de hoek was.

Reacties zijn gesloten.