Hoe installeer ik de nieuwste Large Language Models (LLM's) lokaal op een Mac?

De laatste jaren zijn grote taalmodellen (Large Language Models, LLM's) steeds populairder geworden vanwege hun vermogen om mensachtige tekst te genereren en te helpen bij diverse taken. Niet alle modellen zijn open source, maar vrijwel elk groot technologiebedrijf heeft een versie die gebruikers kunnen downloaden en uitvoeren.

Het lokaal uitvoeren van deze modellen op uw Mac kan voordelen bieden, zowel op het gebied van privacy als kostenbesparing. In dit artikel onderzoeken we hoe u LLM's kunt installeren en uitvoeren met behulp van OllamaHet is een krachtig hulpmiddel voor ontwikkelaars en beginnende gebruikers, en we zullen enkele grafische gebruikersinterfacetools bespreken die het proces kunnen vereenvoudigen voor degenen die liever geen gebruik maken van de macOS Terminal.

Zo krijg je toegang tot de nieuwste AI-gestuurde tekstsjablonen van [Google], [Microsoft], [Meta] en andere AI-bedrijven zoals [Mistral] en [DeepSeek].

LLM's begrijpen: Wat betekenen de parameters?

Voordat we beginnen met het installatieproces, laten we eerst even verduidelijken wat getallen zoals "7B"Of"14BBij verwijzing naar LLM's geven deze getallen de modelgrootte weer in termen van de docenten (In miljarden), die in wezen "hendels en schakelaars" zijn die tijdens de training nauwkeurig worden afgesteld.

Een groter aantal parameters stelt het model in staat complexere patronen en relaties in de taal vast te leggen, wat mogelijk tot betere prestaties leidt. Het is echter belangrijk om te benadrukken dat meer parameters niet altijd betere resultaten garanderen; de kwaliteit van de trainingsdata en de beschikbare rekenkracht van het model spelen ook een belangrijke rol.

Systeem vereisten

Je moet ervoor zorgen dat je [Mac] minimaal aan de volgende specificaties voldoet:

- macOS 10.15 of hoger (macOS 13 of hoger wordt aanbevolen)

- Minimaal 8 GB RAM (16 GB of meer aanbevolen)

- 10 GB vrije opslagruimte (het minimum dat vereist is voor de kleinste modellen; geavanceerdere modellen met een maximaal aantal parameters vereisen ongeveer 700 GB).

- [Intel] multi-core processor of [Apple Silicon] processor (M2 of hoger heeft de voorkeur)

Installeer Ollama

Ollama Het is een open-source tool waarmee je LLM's rechtstreeks op je lokale computer kunt uitvoeren. Zo ga je aan de slag:

- Download OllamaBezoek de website: Ollama Download de macOS-versie. Je kunt het ook installeren met [Homebrew] door het volgende commando uit te voeren:

brew install ollamaIn uw terminal.

- Installeer OllamaAls je het installatieprogramma hebt gedownload, dubbelklik er dan op en volg de installatiewizard. Als je Homebrew gebruikt, ga dan direct naar stap 4.

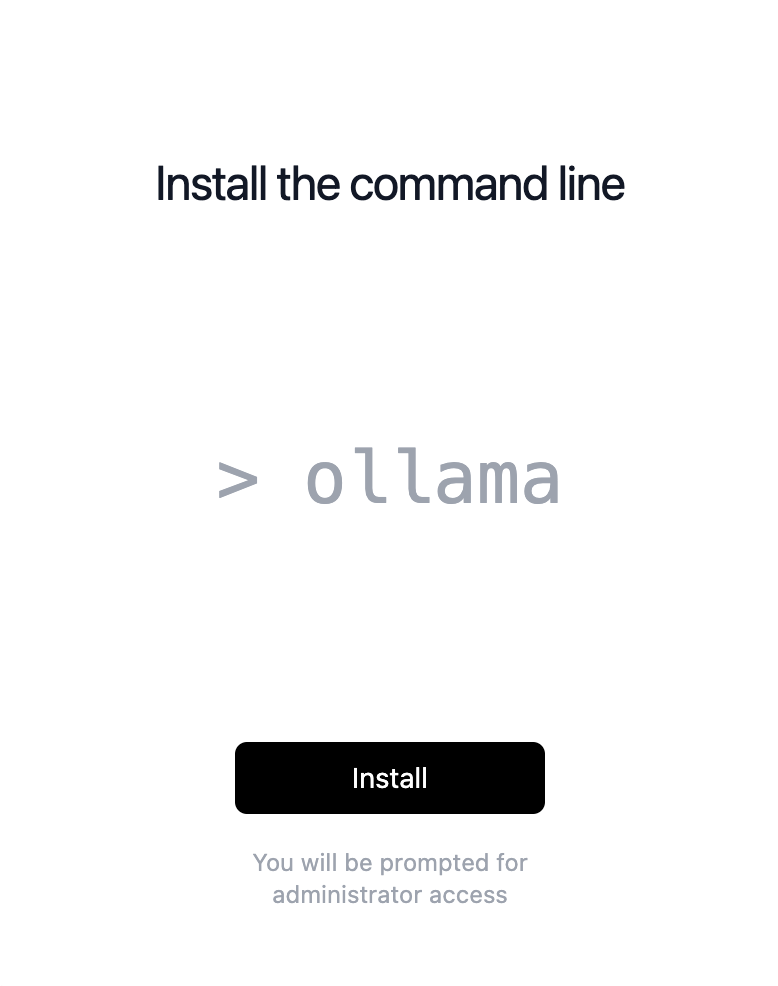

- De volgende stap voor de installateur is simpelweg op de knop klikken. تثبيتHierbij wordt om uw beheerderswachtwoord gevraagd.

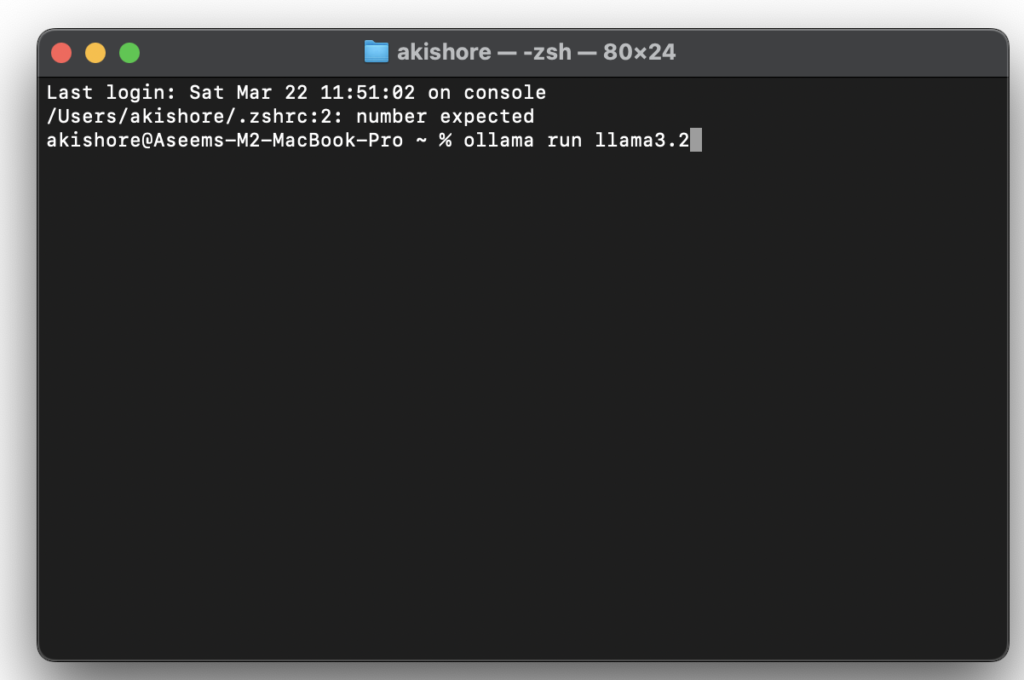

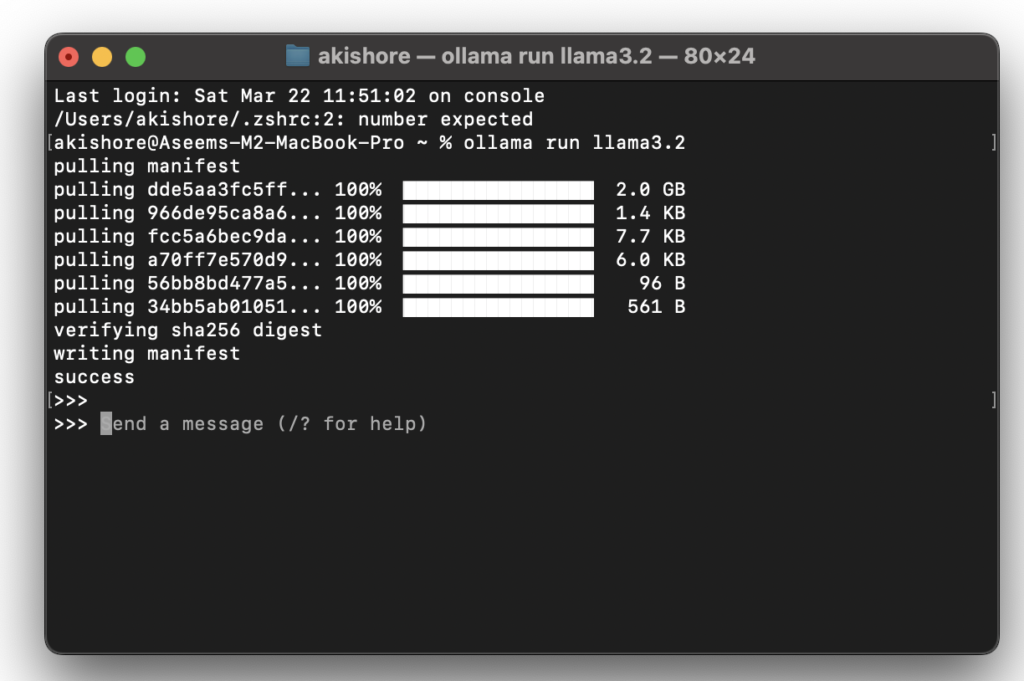

- Voer Ollama uitOpen een terminalvenster en start Ollama als een service met behulp van de volgende opdracht:

brew services start ollamaHierdoor zal Ollama beschikbaar zijn op het adreshttp://localhost:11434/. - Download en voer het model uit.Gebruik het commando

ollama pull <model-name>Om een sjabloon te downloaden, gebruik je de opdrachtollama run <model-name>Om het uit te voeren. Bijvoorbeeld om een model uit te voeren. DeepSeek-R1, gebruik het commandoollama pull deepseek-r1Gevolgd door de bestellingollama run deepseek-r1. - Om een grotere versie van de sjabloon te downloaden, voegt u eenvoudigweg twee verticale puntjes toe, gevolgd door de gewenste afmeting. Bijvoorbeeld: om een sjabloon te downloaden 14B DeepSeekJe gebruikt het commando ollama ren deepseek-r1:14bOp de Ollama-website kunt u op een van de formulieren klikken, waarna alle verschillende commando's voor elke versie worden weergegeven.

Je vindt de volledige lijst hier. Ollama-modellen Hier. Je kunt ook de tweede opdracht gebruiken zoals hierboven beschreven. Als het programma nog niet is geïnstalleerd, wordt eerst het formulier opgehaald en vervolgens uitgevoerd.

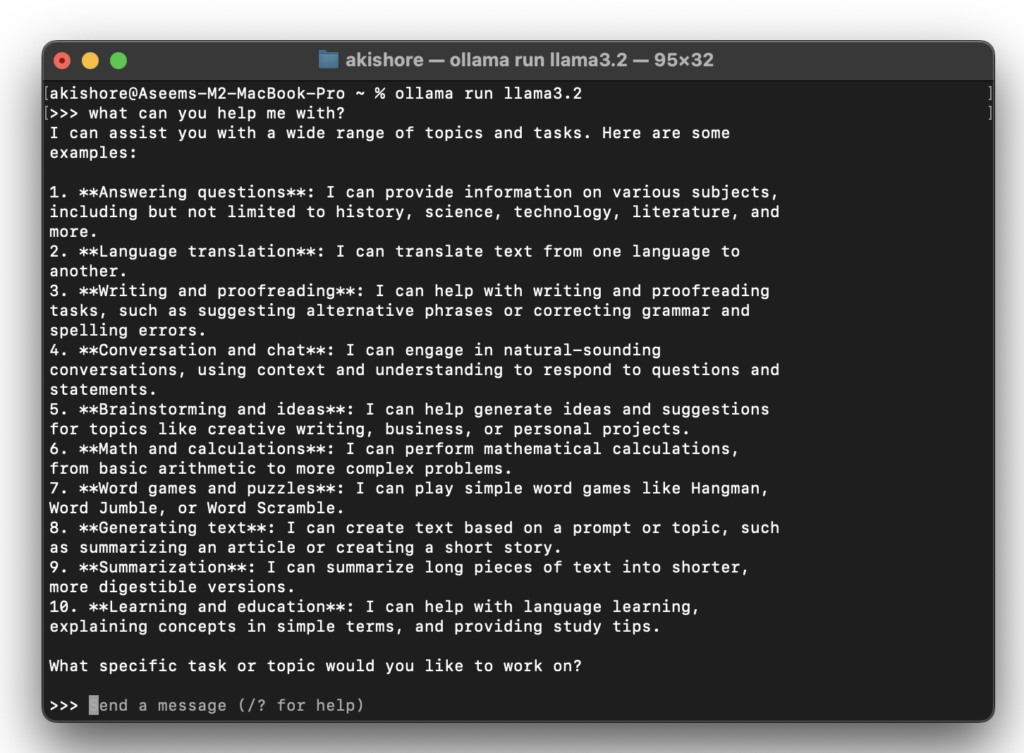

Nu je de drie pijlen in een rechte hoek ziet (>>>), kun je commando's in het formulier typen.

Dat is alles! Je kunt nu lokaal communiceren met je AI LLM zonder je zorgen te maken over kosten, overmatig gebruik of dat anderen kunnen lezen wat je schrijft. Dit is ideaal als je gevoelige of persoonlijke onderwerpen met een AI LLM wilt bespreken, maar niet wilt dat een groot technologiebedrijf je gedachten leest.

Het gebruik van grafische gebruikersinterfacetools met Ollama

Hoewel Ollama krachtig en efficiënt is voor ontwikkelaars, geven sommige gebruikers wellicht de voorkeur aan een grafische gebruikersinterface (GUI) voor interactie met LLM's. Hieronder vindt u enkele tools die een GUI-frontend voor Ollama kunnen bieden:

-

-

- Ollama GUIDit is een gratis en open-source applicatie voor macOS-gebruikers, gebouwd met SwiftUI. Het biedt een prachtige interface en is een uitstekende optie voor wie lokaal toegang wil tot LLM-formulieren zonder de terminal te gebruiken.

- Ollama UIEen eenvoudige, op HTML gebaseerde webinterface waarmee u formulieren rechtstreeks in uw browser kunt definiëren en bewerken. Er is ook een Chrome-extensie beschikbaar voor gemakkelijke toegang.

- Chatbox-AIDit is de eenvoudigste optie voor beginners, en ik zal hieronder uitleggen hoe je het gebruikt. Houd er rekening mee dat je de Chatbox AI-service niet nodig hebt. Dit is een abonnement waarmee je toegang krijgt tot alle LLM-sjablonen zonder Ollama zelf te hoeven installeren.

-

Om de beste Chatbox AI-interface te gebruiken, ga naar download pagina Download de versie voor je Mac.

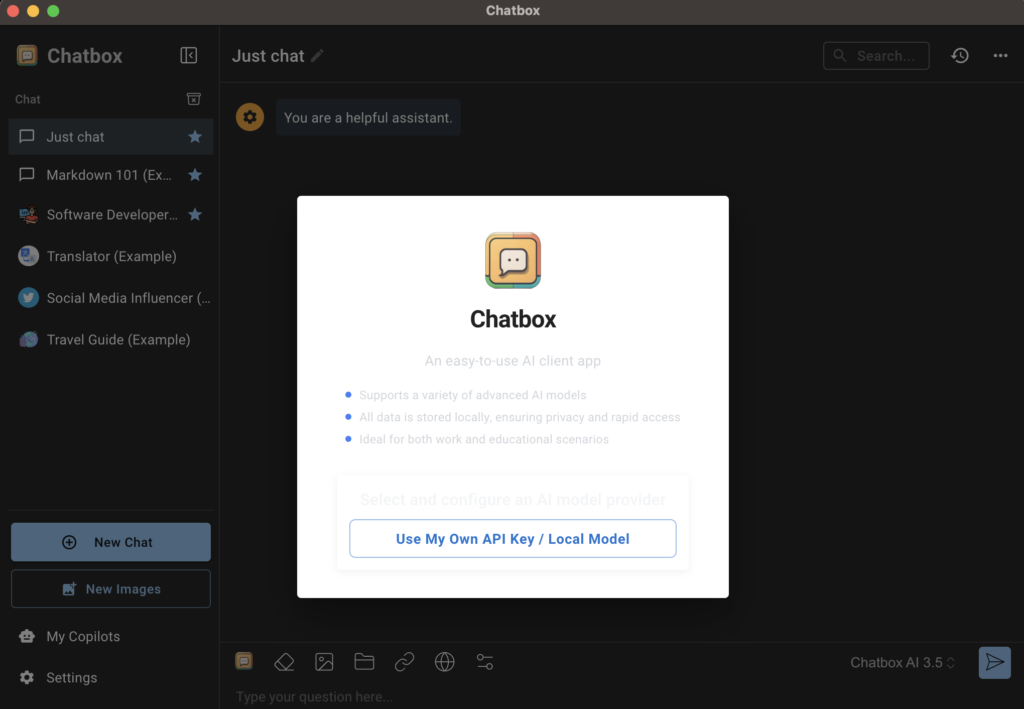

Open vervolgens het installatieprogramma en start het programma. Op het eerste scherm verschijnt een pop-upvenster waarin u wordt gevraagd hoe u Chatbox AI wilt gebruiken.

Je moet op de knop klikken. Mijn eigen API-sleutel gebruiken / Lokaal model.

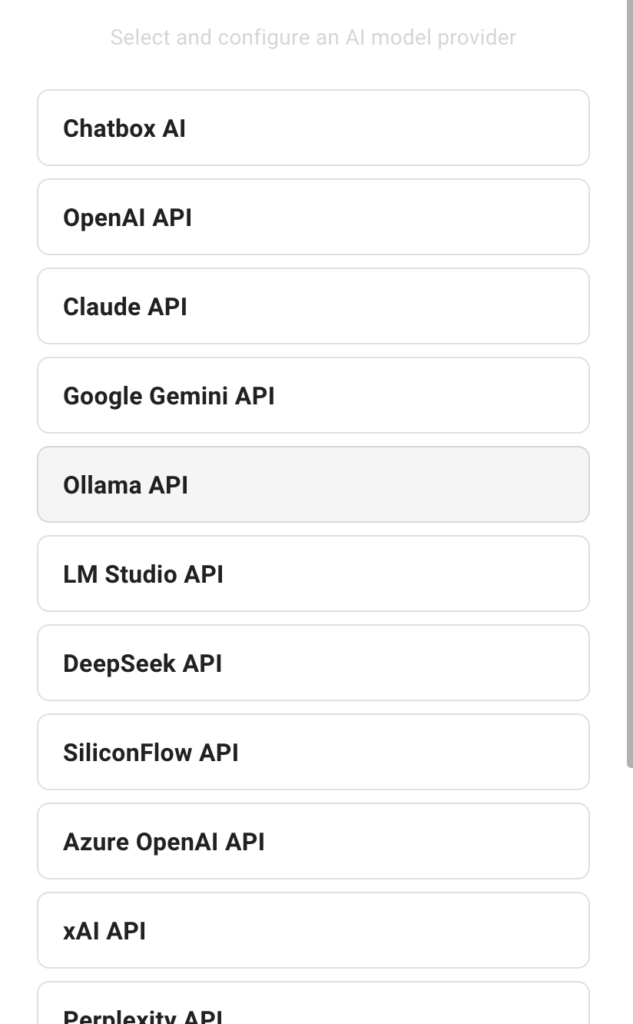

Tik vervolgens op Ollama API Als aanbieder van modellen voor kunstmatige intelligentie.

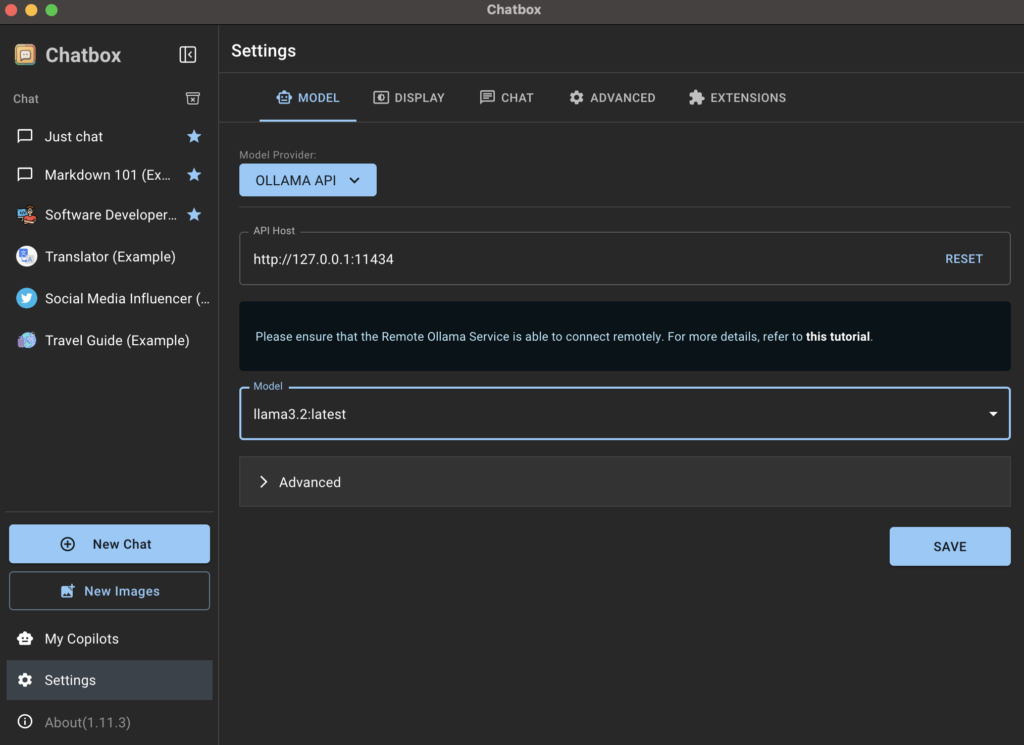

Chatbox AI moet automatisch detecteren dat Ollama actief is en de API-host instellen op de standaardwaarde, namelijk loopback IP-adres en poortnummer 11434Je hoeft hier niets te veranderen. In het formulier zou je de formulieren moeten zien die je eerder via Terminal hebt geïnstalleerd. In mijn geval is dat het formulier. lama 3.2.

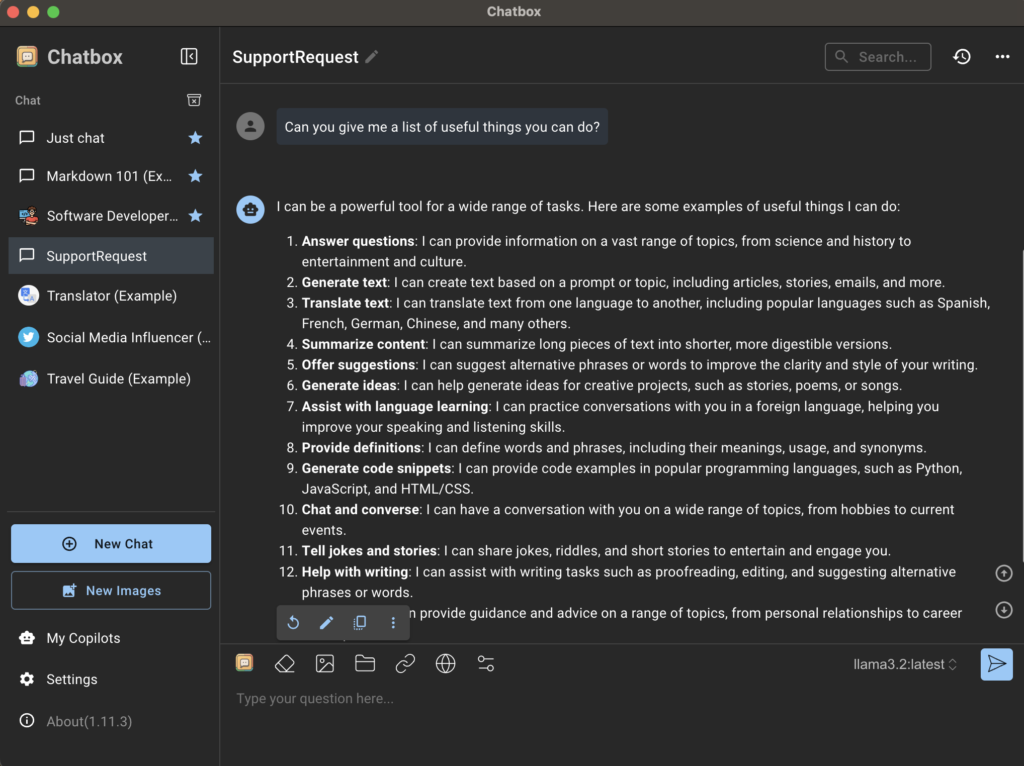

Ga terug naar de startpagina van de app en klik op gewoon chatten أو Nieuw gesprek Zorg ervoor dat je rechtsonder het juiste sjabloon selecteert. Je kunt het sjabloon op elk moment wijzigen, maar ik raad aan om voor elk sjabloon dat je gebruikt een nieuwe chat aan te maken, zodat je de verschillen gemakkelijk kunt zien.

Alternatieve tools voor het lokaal uitvoeren van LLM-modellen

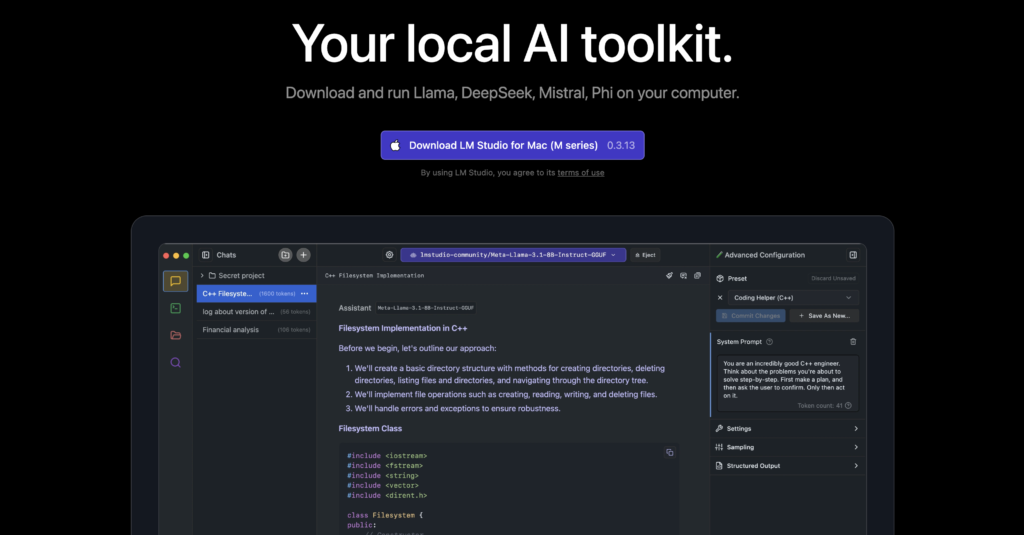

Als je op zoek bent naar alternatieven voor Ollama of vanaf het begin een gebruiksvriendelijkere ervaring wilt, dan LM Studio Het is wederom een uitstekende optie. Het biedt een gebruiksvriendelijke interface voor het verkennen en gebruiken van diverse AI-modellen, waardoor je ze gemakkelijk kunt downloaden en uitvoeren. LM Studio is beschikbaar voor Linux, Mac en Windows en biedt functies zoals het aanpassen van modelparameters en chatgeschiedenis. Het is momenteel gratis, daarom raad ik het aan boven de Chatbox AI-abonnementsservice.

Conclusie

Het lokaal uitvoeren van grote taalmodellen (LLM's) op je Mac is belangrijk voor iedereen die meer controle wil over zijn AI-toepassingen en prioriteit wil geven aan gegevensprivacy. Met tools zoals Ollama en de eerder genoemde grafische interfaces, waarmee je LLM's eenvoudig in je workflow kunt integreren, kun je op een veilige manier nieuwe mogelijkheden voor productiviteit en creativiteit ontsluiten.

Het opzetten van een lokale LLM-implementatie vereist echter wel enig inzicht in de parameters en hoe deze de prestaties van de modellen op uw specifieke machine beïnvloeden. De beste manier om dit te leren is door te experimenteren met verschillende modellen om te zien welke de beste resultaten opleveren. Zodra u dit concept begrijpt, kunt u betere beslissingen nemen over welke modellen u moet gebruiken en hoe u hun prestaties kunt optimaliseren om aan uw specifieke behoeften te voldoen.

Reacties zijn gesloten.