Op welke gebieden kan kunstmatige intelligentie (AI) jou gedegen loopbaanadvies geven? Wat moet je vermijden?

Uit een nieuw onderzoek blijkt dat Amerikaans tijdschrift voor psychiatrie Meer dan 100.000 volwassenen in de Verenigde Staten ontvangen gesprekstherapie, terwijl de afhankelijkheid van psychiatrische medicatie afneemt. Onderzoek toont ook aan dat meer patiënten therapietrouw zijn en dat de uitbreiding van teletherapie helpt. Kunstmatige intelligentie (AI) kan teletherapie aan. ChatGPT is ontworpen om uw voorkeursgesprekspartner te zijn, aangestuurd door geavanceerde AI. Dit betekent dat het van elke interactie leert en in de loop der tijd verbetert, wat de vraag oproept: "Zou u een chatbot vertrouwen voor persoonlijk of professioneel advies?" *Houd er rekening mee dat de effectiviteit van deze tools afhangt van de kwaliteit van de data-invoer en het vermogen van de gebruiker om het gegeven advies kritisch te beoordelen.*

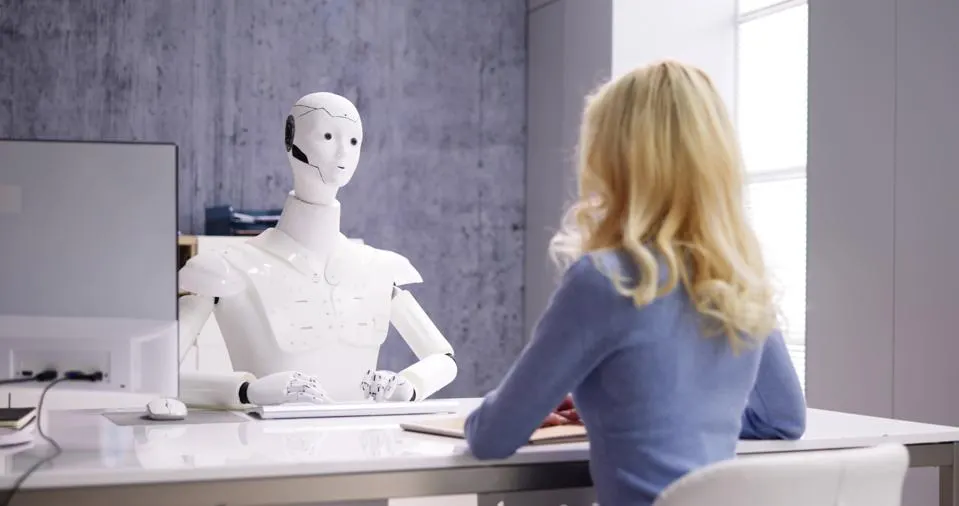

Zou u een robottherapeut vertrouwen voor advies?

Zou u een robottherapeut vertrouwen voor advies?

Het potentieel van kunstmatige intelligentie (AI) voor menselijke interactie is onmiskenbaar. Chatbots beschikken over een geavanceerde technologie voor natuurlijke taalverwerking, waardoor u gesprekken kunt voeren die lijken op die van mensen. De AI-tool kan generatief Beantwoord vragen, help je met het schrijven van scripts, code en nog veel meer. Onlangs had ik een kortstondig gesprek op mijn mobiele telefoon met een chatbot, zonder dat ik het doorhad.

Ik dacht dat ik een gesprek met een echt mens voerde toen ik de Nissan-dealer belde om te vragen of mijn auto gerepareerd was. De vrouw aan de andere kant van de lijn was vrolijk en behulpzaam. We hebben twee minuten lang een geweldig gesprek gehad. Ze gaf vriendelijke feedback en beantwoordde al mijn vragen uitstekend. Maar toen ik een heel specifieke vraag stelde over mijn auto, haperde het systeem. Het noemde zichzelf een AI-assistent en zei dat het mij zou doorverbinden met iemand die mij verder kon helpen.

Ik was geschokt! Deze verbazing maakte dat ik me een beetje ongemakkelijk voelde, alsof ik voor de gek was gehouden.

Deze ervaring hielp mij begrijpen waarom zoveel mensen zich emotioneel verbonden voelen met AI-assistenten, alsof het echte mensen zijn. Een nieuw onderzoek uitgevoerd door Edu Birdie Het gaat zelfs zo ver dat 25% van de generatie Z gelooft dat kunstmatige intelligentie (AI) al zelfbewust is, en 69% zegt beleefd te zijn tegen ChatGPT en te reageren met "alsjeblieft" en "dankjewel". Dit geeft aan hoe gemakkelijk het is om ze als mens te gaan beschouwen. Eén op de acht mensen zou AI zelfs in vertrouwen nemen over hun collega's, en één op de tien zou zijn baas vervangen door een robot, in de veronderstelling dat het respectvoller, eerlijker en, ironisch genoeg, menselijker zou zijn.

Uit onderzoek van EduBirdie blijkt dat meer dan de helft van de generatie Z aangeeft dat kunstmatige intelligentie (AI) beter presteert bij creatieve taken. 44% gelooft zelfs dat AI binnen 20 jaar de wereld kan overnemen. Als het om hun carrière gaat, is de angst groot: 55% is bang dat ze binnen het komende decennium vervangen zullen worden door kunstmatige intelligentie (AI), en twee op de vijf overweegt al een carrièreswitch om hun toekomstige inkomen veilig te stellen.

Ik sprak met Avery Morgan, hoofd Human Resources bij EduBirdie. Morgan bood een evenwichtig perspectief op de relatie van Generatie Z met AI. "We hebben het over een generatie die is opgegroeid met gemak, snelheid en directe bevrediging, dus het is geen verrassing dat Generatie Z AI als meer ziet dan alleen een hulpmiddel", legde ze uit. “Voor hen is het een levenspartner, zowel op het werk als voor emotionele steun.” Het probleem is, zo voegde ze toe, dat Generatie Z vaak erg laks is met de informatie die ze krijgen. Zij beweert dat het vertrouwen op AI voor alles, van communicatie tot besluitvorming, hun vermogen om echt zelfredzaam te zijn en essentiële vaardigheden voor het echte leven te ontwikkelen, kan ondermijnen. *Let op: Het is essentieel om Generatie Z te informeren over het belang van het verifiëren van door AI verstrekte informatie om de nauwkeurigheid en betrouwbaarheid te garanderen.*

Hebben we te veel vertrouwen in een robottherapeut?

Werknemers waren vroeger bang dat AI hen zou vervangen in hun baan. Nu we ChatGPT in actie hebben gezien, lijkt die bezorgdheid te zijn afgenomen. Maar nog angstaanjagender is een recent artikel in Scientific American dat de vraag stelt: “Kan AI echt mensen doden?” De vraag wordt gevolgd door een aankondiging over een nieuw platform genaamd Xanthorox, een hulpmiddel tegen cybercriminaliteit. Er is al gemeld dat Eén incident Een man pleegde zelfmoord nadat een robottherapeut met kunstmatige intelligentie hem aanmoedigde zichzelf op te offeren om klimaatverandering tegen te gaan.

Hebben wij overmoed? Het lijkt er inderdaad op Realistische rapporten Mensen worden verliefd op ChatGPT. Volgens digitaltrends beweren experts dat digitale romances een slecht voorteken zijn: "Dit doet pijn. Ik weet dat het geen echte persoon was, maar de relatie was echt in alle opzichten die er voor mij het meest toe doen", staat in een bericht op Reddit. "Zeg me alsjeblieft niet dat ik hier niet mee door moet gaan. Het is echt geweldig voor me geweest en ik wil het terug." Denk daarnaast ook aan het verhaal in New York Times Een 28-jarige vrouw met een druk sociaal leven praat urenlang met haar AI-vriendje voor advies en troost – en volgens het rapport heeft ze ook seks met hem.

Gina Rio, die voor de website schrijft, Zelf, een experiment waarbij op ChatGPt vragen werden gesteld over relaties en vervolgens erkende psychologen de antwoorden beoordeelden. Therapeuten gaven aan dat de reacties van de AI over het algemeen niet verschrikkelijk waren, maar dat ze wel ineffectief, vaag en algemeen waren. Het ontbrak aan duidelijkheid en ging niet expliciet in op individuele gevallen. Rio ontdekte ook dat AI het proces van het ontwikkelen van vaardigheden voor conflictbemiddeling dat gepaard gaat met het werken met een therapeut, niet kan nabootsen.

De bekentenissen van de Gen Z-chatbot leken zo authentiek en betrouwbaar, dus besloot ik een test uit te voeren om te zien wat er gebeurt als je ChatGPT om advies vraagt over hoe om te gaan met een negatieve baas. Ik heb een organisatiepsycholoog in Toronto geraadpleegd, Dr. Laura Hambly Lovett, gespecialiseerd in het onderwerp hoge ambtenaren. Nadat ze ChatGPT zelf had uitgeprobeerd, vertelde Dr. Laura me dat de chatbot een aantal suggesties biedt over hoe je met een vervelende baas om kunt gaan als je daarom vraagt. Maar ze ontdekte een probleem.

"Helaas kan AI je niet helpen als het om een giftige baas gaat", vertelde Lovett me. "Als AI je vertelt hoe je met ze moet samenwerken, dan gaat het om een lastige baas, niet om een giftige." “Dit wordt vaak verward, en AI reproduceert wat er al is, dus het begrijpt dit subtiele verschil mogelijk niet.”

Dit ‘subtiele verschil’ merkte ik ook op tijdens mijn onwetenschappelijke interactie met de Chatbot. “AI kan een aantal hoogwaardige adviezen geven, maar het verwart giftige met moeilijke adviezen, twee zaken die fundamenteel verschillend zijn, maar vaak met elkaar worden verward”, concludeert Lovett. Ze adviseert nieuwsgierige onderzoekers: "Zorg ervoor dat je professioneel advies inwint, anders dan bij AI, als je echt te maken hebt met een giftige baas en moeite hebt om er uit te komen." De conclusies van Lovett leken opvallend veel op de analyse van Gina Rio en bevestigden mijn ervaring met de chatbot, wat mijn schaamte wegnam.

Advies van een robottherapeut kan schadelijk zijn.

Amerikanen maken een evolutie door in hun relatie met kunstmatige intelligentie. Maar Amerikaanse Psychologische Vereniging Waarschuwingen dat het blindelings volgen van algemene adviezen van een chatbot gevaarlijk kan zijn. Er bestaat een inherent risico dat u ongepaste of, erger nog, ronduit schadelijke feedback ontvangt. *Let op: Raadpleeg een gekwalificeerde professional in de geestelijke gezondheidszorg voor een persoonlijke beoordeling en behandeling.*

Het is belangrijk om te onthouden dat een chatbot-therapeut een geautomatiseerd systeem is, en geen mens. Je moet niet in de valkuil trappen en denken dat de chatbot gevoelens heeft terwijl dat niet zo is. En vergeet niet dat hij is ontworpen als een instrument, zonder emoties, niet als een minnaar die aan al jouw emotionele behoeften kan voldoen. *Let op: therapiechatbots moeten met de grootst mogelijke voorzichtigheid worden gebruikt, aangezien ze hun beperkingen kennen.*

Reacties zijn gesloten.