Hoe AI de dagelijkse taken van datawetenschappers herschrijft

Van het elimineren van taken met een lage toegevoegde waarde tot het versnellen van projecten met een grote impact: lees hoe AI de workflows in de datawetenschap verandert.

In mijn vorige artikelen heb ik verschillende AI-tools onderzocht en vergeleken, bijvoorbeeld Google's Data Science Agent, ChatGPT versus Claude versus Gemini Voor datawetenschap en DeepSeek V3, enz. Dit is echter slechts een kleine subset van alle AI-tools die beschikbaar zijn voor data Science. Hier volgen enkele hulpmiddelen die ik in mijn werk heb gebruikt:

- OpenAI-API:Ik gebruik het om feedback van klanten te categoriseren en samen te vatten en om zwakke punten van producten te identificeren.

- ChatGPT و GeminiZe helpen mij met het opstellen van Slack-berichten en e-mails, het schrijven van analyserapporten en zelfs beoordelingen van prestaties.

- Verzamel AI:Glean gebruikte AI om snel antwoorden te vinden in documenten en interne communicatie.

- Cursor و Copilot: Ik vind het fijn om gewoon op Tab-Tab te drukken om code en opmerkingen automatisch te laten aanvullen.

- Hex MagieIk gebruik Hex voor het samenwerken aan spreadsheets op het werk. Het biedt ook een functie genaamd Hex Magie Om code te schrijven en bugs op te lossen met behulp van conversationele AI.

- Sneeuwvlok cortexMet Cortex AI kunnen gebruikers LLM-eindpunten aanroepen, RAG's en tekst-naar-SQL-services bouwen met behulp van gegevens in Snowflake.

Ik weet zeker dat je deze lijst nog verder kunt aanvullen, en er komen elke dag nieuwe AI-tools uit. Het is bijna onmogelijk om op dit moment een complete lijst te maken. Daarom wil ik in dit artikel even een stap terug doen en me richten op een grotere vraag: Wat hebben wij als dataprofessionals echt nodig en hoe kan AI daarbij helpen?؟

In het onderstaande gedeelte richt ik mij op twee belangrijke trends: het elimineren van taken met een lage toegevoegde waarde en het versnellen van werk met een hoge toegevoegde waarde.

1. Elimineer taken met een lage waarde

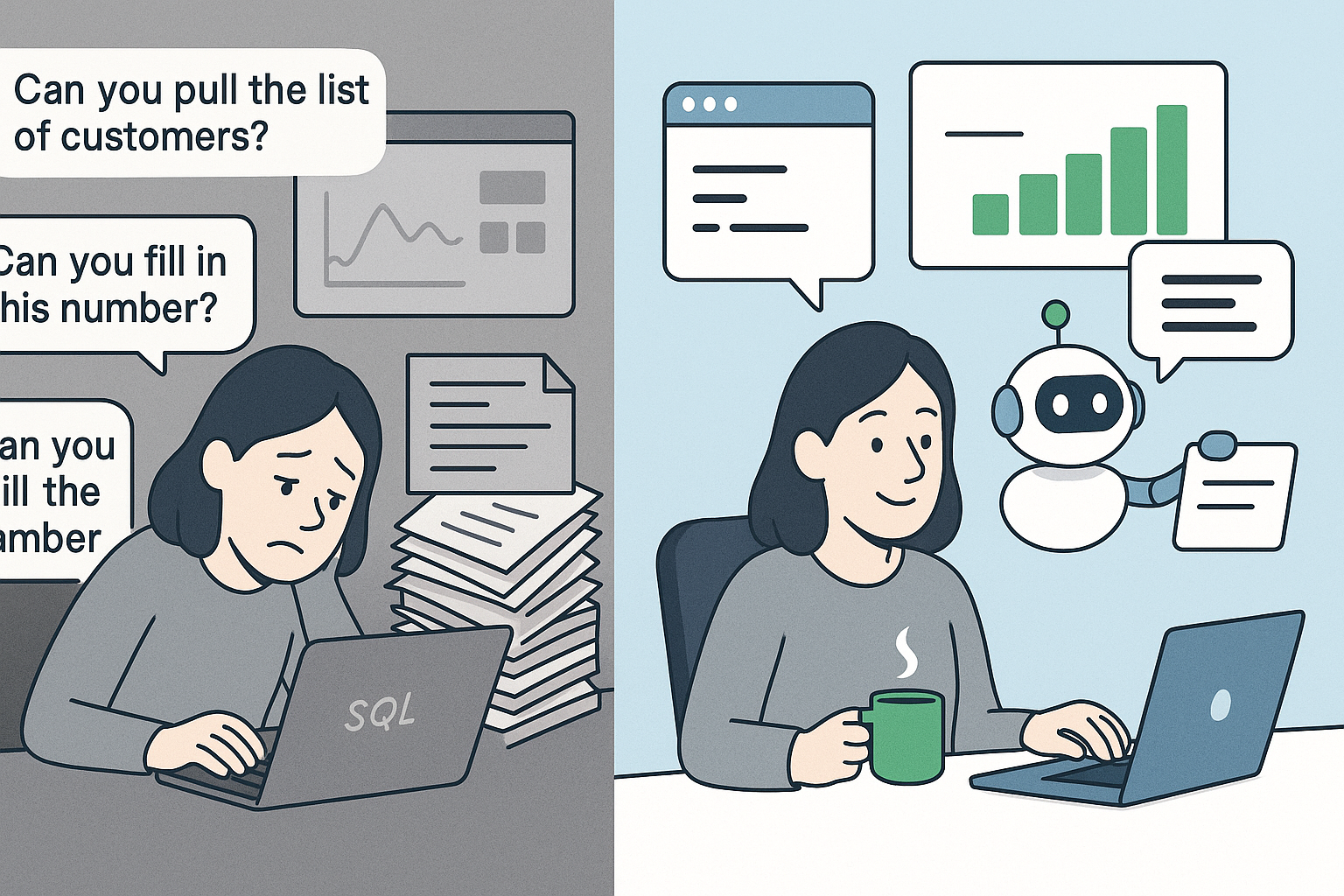

Ik ben datawetenschapper geworden omdat ik het ontzettend leuk vind om complexe data om te zetten in zakelijke inzichten en op basis daarvan zakelijke beslissingen te nemen. Maar nu ik al meer dan 7 jaar in dit vakgebied zit, moet ik toegeven dat niet al het werk zo spannend is als ik had gehoopt. Voordat we geavanceerde analyses kunnen uitvoeren of machine learning-modellen kunnen bouwen, zijn er veel workflows met een lage waarde die dagelijks onvermijdelijk zijn. In veel gevallen komt dit doordat we niet over de juiste tools beschikken om onze stakeholders te voorzien van selfservice-analyses. Laten we eens kijken naar onze huidige situatie en het ideale geval:

Huidige status: Wij fungeren als data-interpreters en poortwachters (soms “SQL-apen”)

- Eenvoudige data pull requests Elke week komt ze op Slack naar mij en mijn team toe met de vraag: "Wat was jullie bruto handelswaarde (GMV) vorige maand?" “Kunt u een lijst opvragen van cliënten die aan deze criteria voldoen?” “Kunt u mij helpen dit nummer in te vullen voor de presentatie die ik morgen moet geven?”

- Business Intelligence (BI)-tools bieden weinig ondersteuning voor selfservice-use cases.. We hebben business intelligence-hulpmiddelen zoals Looker en Tableau geïmplementeerd, zodat belanghebbenden eenvoudig gegevens kunnen verkennen en statistieken kunnen bewaken. Maar de waarheid is dat er altijd een afweging moet worden gemaakt tussen eenvoud en de mogelijkheid tot zelfbediening. Soms maken we dashboards eenvoudig te begrijpen met een paar statistieken, maar deze zijn alleen geschikt voor een beperkt aantal use cases. Als we de tool echter zo aanpasbaar maken dat ze de onderliggende statistieken en data vrijelijk kunnen verkennen, vinden belanghebbenden de tool mogelijk verwarrend en hebben ze er geen vertrouwen in om hem te gebruiken. In het ergste geval kunnen er zelfs gegevens worden opgehaald en verkeerd worden geïnterpreteerd.

- Er zijn weinig documenten of deze zijn verouderd.. Dit is een veelvoorkomende situatie, maar kan verschillende oorzaken hebben. Misschien handelen we te snel en richten we ons op het leveren van resultaten, of is er geen goed beleid voor de documentatie van gegevens en het beheer ervan. Hierdoor wordt tribale kennis een knelpunt voor mensen buiten het datateam om de data te gebruiken.

Ideaal geval: stakeholders in staat stellen om zelf aan de slag te gaan, zodat we werk met een lage waarde kunnen verminderen

- Stakeholders kunnen eenvoudig gegevens ophalen en eenvoudig en met vertrouwen basisvragen over gegevens beantwoorden.

- Datateams besteden minder tijd aan het voorbereiden van repetitieve rapporten of eenvoudige eenmalige query's.

- Dashboards zijn vindbaar, interpreteerbaar en bruikbaar zonder directe assistentie.

Welke rol kan AI spelen om dichter bij het ideale te komen? Naar wat ik heb waargenomen, zijn dit de algemene trends die AI-tools volgen om de kloof te dichten:

- Natuurlijke taalgegevensquery (tekst-naar-SQL)Eén manier om de technische barrière te verlagen, is om belanghebbenden de mogelijkheid te geven om gegevens in natuurlijke taal te bevragen. Er zijn veel Text-to-SQL-initiatieven in de sector:

- bijvoorbeeld, Sneeuwvlok Het is een van de bedrijven die veel vooruitgang heeft geboekt in Text2SQL-modellen En begon deze functionaliteit in het product te integreren.

- Veel bedrijven (waaronder het mijne) hebben ook intern Text2SQL-oplossingen onderzocht. Ik heb bijvoorbeeld deelgenomen Uber Haar reis met QueryGPT van Uber Om het opvragen van gegevens eenvoudiger te maken voor het operationele team. In dit artikel wordt beschreven hoe Uber een multi-agentarchitectuur heeft ontworpen voor het genereren van query's. Tegelijkertijd kwamen ook belangrijke uitdagingen op dit gebied aan het licht, waaronder het nauwkeurig interpreteren van de bedoeling van de gebruiker, het verwerken van grote tabelgrafieken, het voorkomen van hallucinaties, enzovoort.

- Eerlijk gezegd moet je de query heel nauwkeurig maken om Text-to-SQL te laten werken. Zelfs als de tool maar één keer faalt, kan dat het vertrouwen schaden en uiteindelijk zullen belanghebbenden bij je terugkomen om de query's te valideren (en dan moet je de query's weer lezen en herschrijven, wat het werk bijna verdubbelt 🙁). Tot nu toe heb ik nog geen Text-to-SQL-sjabloon of -tool gevonden die perfect werkt. Ik denk dat dit alleen haalbaar is als je een zeer kleine subset van goed gedocumenteerde onderliggende datasets raadpleegt voor specifieke, gestandaardiseerde use cases. Het is echter heel moeilijk om op te schalen naar alle beschikbare gegevens en verschillende bedrijfsscenario's.

- Maar natuurlijk, gezien de enorme investeringen op dit gebied en de snelle ontwikkeling van AI, ben ik er zeker van dat we steeds dichter bij nauwkeurige en schaalbare Text-to-SQL-oplossingen komen.

- Chatgebaseerde Business Intelligence (BI)-assistentEen andere populaire manier om de ervaring van belanghebbenden met BI-tools te verbeteren, is door middel van een chatgebaseerde BI-assistent. Dit gaat feitelijk nog een stap verder dan Text-to-SQL: in plaats van een SQL-query te genereren op basis van de prompt van de gebruiker, reageert het in een visualisatieformaat en een tekstuele samenvatting.

- Tweelingen in Looker Hij is hier een voorbeeld. Looker is eigendom van Google, dus het is een logische stap om hen te integreren met Gemini. Een ander voordeel dat Looker heeft voor het bouwen van hun AI, is dat gegevensvelden al zijn gedocumenteerd in de semantische laag van LookML, met gedefinieerde algemene toewijzingen en opgenomen algemene statistieken in dashboards. Er zijn dus heel veel waardevolle gegevens waaruit we kunnen leren. Met Gemini kunnen gebruikers Looker-dashboards aanpassen, vragen stellen over de gegevens en zelfs aangepaste gegevensagenten bouwen voor conversatieanalyses. Hoewel ik beperkte ervaring heb met de tool, kan ik zeggen dat deze soms zelfs de simpelste vragen niet beantwoordt. Laat me weten of je een andere ervaring hebt gehad en het wel gelukt is…

- Tableau heeft ook een soortgelijke functie gelanceerd, Tableau-AI. Ik heb het zelf niet gebruikt, maar op basis van de demo kan ik zeggen dat het het datateam helpt bij het voorbereiden van data, het snel maken van dashboards met behulp van natuurlijke taal en het samenvatten van data-inzichten in Tableau Pulse, zodat belanghebbenden eenvoudig metrische wijzigingen en afwijkende trends kunnen identificeren.

- Hulpmiddelen voor gegevensindexeringAI kan ook helpen bij het overwinnen van het probleem dat ontstaat door het ontbreken van of nauwelijks datadocumentatie.

- Ik kan me nog herinneren dat een van de projecten van onze data engineers tijdens een interne hackathon ging over het gebruik van LLM om de dekking van tabeldocumentatie te vergroten. AI kan in de meeste gevallen de codebasis lezen en kolommen op basis daarvan met grote nauwkeurigheid beschrijven. Hierdoor kan AI de documentatie snel verbeteren met beperkte menselijke validatie en aanpassingen.

- Op dezelfde manier vragen we Cursor om YAML-bestanden te schrijven voor de tabeldocumentatie wanneer mijn team nieuwe tabellen aanmaakt. Zo besparen we tijd en krijgen we een uitvoer van hoge kwaliteit.

- Er zijn ook veel gegevenscatalogi en governancetools geïntegreerd met AI. Als ik op Google zoek naar ‘AI data index’, zie ik logo’s van tools voor data-indexering zoals Atlan, Alation, Collibra, Informatica, etc. (Disclaimer: ik heb ze nog nooit gebruikt). Dit is een duidelijke trend in de sector.

2. Versnel werk met een hoge waarde

Nu we hebben besproken hoe AI taken met een lage toegevoegde waarde kan elimineren, gaan we bespreken hoe AI dataprojecten met een hoge toegevoegde waarde kan versnellen. Met ‘hoogwaardig werk’ worden in dit geval dataprojecten bedoeld die technische excellentie combineren met de context van het bedrijf en die een betekenisvolle impact bereiken door cross-functionele samenwerking. Denk bijvoorbeeld aan een diepgaande analyse die inzicht geeft in productgebruikspatronen en de aanleiding voor productwijzigingen, of een model voor het voorspellen van klantverloop om klanten te identificeren die risico lopen op klantverloop en om initiatieven ter voorkoming van klantverloop te ontwikkelen. Laten we de huidige situatie vergelijken met de ideale toekomst:

Huidige status: Er zijn knelpunten in Productiviteit In de dagelijkse workflow

- Exploratieve data-analyse (EDA) is tijdrovend.. Deze stap is essentieel om een eerste inzicht in de data te krijgen, maar het uitvoeren van alle univariate en multivariate analyses kan tijdrovend zijn.

- Tijdverspilling met coderen en debuggen. Laten we eerlijk zijn: niemand kan alle numpy-, pandas- en sklearn-modelparameters onthouden. Tijdens het coderen moeten we voortdurend naar documentatie zoeken.

- Rijke, ongestructureerde data worden niet volledig benut.. Bedrijven genereren dagelijks grote hoeveelheden tekstgegevens via enquêtes, supporttickets en beoordelingen. Maar het blijft een uitdaging om op schaalbare wijze inzichten te verkrijgen.

Ideaal scenario: Datawetenschappers richten zich op diepgaand nadenken, niet op syntaxis.

- Het schrijven van code gaat sneller, omdat je niet naar de syntaxis hoeft te zoeken.

- Analisten besteden meer tijd aan het interpreteren van resultaten en minder tijd aan het werken met data.

- Ongestructureerde data vormen geen belemmering meer en kunnen snel worden geanalyseerd.

Wanneer u het ideale scenario voor ogen hebt, heeft u vast al een aantal AI-tools in gedachten. Laten we eens kijken hoe AI daadwerkelijk een impact kan hebben of het verschil kan maken:

- AI-assistenten voor codering en debuggen. Ik denk dat dit veruit het meest betrouwbare type AI-tool is voor iedereen die programmeert. We zien het alweer gebeuren.

- Wanneer LLM-chatbots zoals ChatGPT و ClaudeIngenieurs kwamen erachter dat ze hun syntaxisvragen of foutmeldingen eenvoudig aan een chatbot konden stellen, die vervolgens zeer nauwkeurige antwoorden zou krijgen. Dit verstoort nog steeds je programmeerworkflow, maar het is een stuk beter dan door tientallen StackOverflow-tabbladen te klikken – en dat voelt nu al als de vorige eeuw.

- Later zien we steeds meer geïntegreerde AI-coderingstools ontstaan – geïntegreerde GitHub-copiloot و Cursor Met uw code-editor kunnen ze uw codebase lezen en proactief codeaanvulling voorstellen en problemen in uw IDE opsporen.

- Zoals ik in het begin al kort aangaf, zijn datatools zoals Sneeuwvlok و Hex Het bevat ook AI-coderingsassistenten waarmee data-analisten en datawetenschappers eenvoudig code kunnen schrijven.

- Kunstmatige intelligentie voor exploratieve data-analyse en -analyse. Dit lijkt enigszins op de chatgebaseerde BI-assistentietools die ik hierboven noemde, maar het doel is ambitieuzer: het begint met onbewerkte datasets en is gericht op het automatiseren van de volledige analysecyclus van gegevensopschoning, voorverwerking, verkennende analyse en soms zelfs modellering. Dit zijn de tools die vaak worden aangeprezen als ‘vervanging voor data-analisten’ (maar is dat wel zo?).

- Google Data Science-agent Het is een zeer indrukwekkende nieuwe tool waarmee je met één eenvoudige prompt een compleet Jupyter Notebook kunt maken. Ik schreef onlangs een artikel Legt uit wat hij wel en niet mag doen. Kortom, het kan snel een goed georganiseerde Jupyter Notebook maken die draait op basis van een aanpasbaar uitvoeringsplan. Het programma mist echter de mogelijkheden om een Jupyter Notebook aan te passen op basis van vervolgvragen. Ook is er nog steeds iemand nodig met sterke kennis van data science om methoden te beoordelen en handmatige iteraties uit te voeren. Daarnaast is een duidelijke omschrijving van het dataprobleem vereist, met schone, goed gedocumenteerde datasets. Ik zie het dus als een geweldig hulpmiddel om tijd te besparen in de eerste code, in plaats van dat het onze banen in gevaar brengt.

- Het kan ook worden geclassificeerd als ChatGPT-gegevensanalysetool Binnen dit kader. Hiermee kunnen gebruikers een dataset uploaden en ermee chatten om hun analyses uit te voeren, visualisaties te maken en vragen te beantwoorden. U kunt mijn vorige artikel over de mogelijkheden ervan lezen. hier. Het kent ook vergelijkbare uitdagingen en functioneert beter als EDA-assistent dan als vervanging van data-analisten.

- NLP-mogelijkheden zijn eenvoudig te gebruiken en schaalbaar.. LLM is goed in gesprekken voeren. Daarom is NLP dankzij de huidige LLM een stuk eenvoudiger geworden.

- Mijn bedrijf organiseert elk jaar een interne hackathon. Ik kan me nog herinneren dat ik drie jaar geleden een hackathonproject had waarbij ik BERT en andere traditionele topic modeling-methoden uitprobeerde om de reacties op NPS-enquêtes te analyseren. Dat was leuk, maar eerlijk gezegd heel moeilijk om het nauwkeurig en betekenisvol voor het bedrijf te maken. Twee jaar geleden hebben we tijdens een hackathon geprobeerd OpenAI-API Om de feedbackgegevens zelf te classificeren en samen te vatten – het werkte perfect en maakte high-fidelity thematische modellering, sentimentanalyse en feedbackclassificatie mogelijk, allemaal in slechts één API-aanroep. De output paste perfect binnen onze bedrijfscontext op basis van systeemprompts. Later bouwden we een interne pijplijn die eenvoudig kon worden uitgebreid met tekstgegevens uit enquêtereacties, supporttickets, verkoopgesprekken, notities van gebruikersonderzoek, enzovoort. Het werd de centrale hub voor klantfeedback en vormde de basis voor onze productroadmap. U vindt Plus op Deze technische blog.

- Er zijn ook veel nieuwe bedrijven die op AI gebaseerde tools voor het analyseren van klantfeedback, productbeoordelingen, klantenservice-assistenten en nog veel meer ontwikkelen. De ideeën zijn allemaal hetzelfde: gebruikmaken van de manier waarop LLM de context van tekst kan begrijpen en gesprekken kan voeren om AI-agenten te creëren die gespecialiseerd zijn in tekstuele analyse.

Conclusie

Het is gemakkelijk om verstrikt te raken in de nieuwste hulpmiddelen op het gebied van kunstmatige intelligentie (AI). Maar uiteindelijk is het allerbelangrijkste dat we met behulp van AI de zaken die ons vertragen, kunnen elimineren en de zaken die ons vooruit helpen, kunnen versnellen. De sleutel is om pragmatisch te blijven: omarm wat vandaag werkt, blijf nieuwsgierig naar wat zich aandient en verlies nooit het hoofddoel van datawetenschap uit het oog: betere beslissingen nemen door beter begrip.

Reacties zijn gesloten.