Mijn persoonlijke ervaring: een echte AI-chatbot lokaal op een iPhone draaien

Chatbots op basis van kunstmatige intelligentie, zoals: ChatGPT و Gemini...om te vertrouwen op cloud computing om te functioneren. Maar wat als je een groot taalmodel (LLM) rechtstreeks op je iPhone zou kunnen draaien, zonder dat je een abonnement, internetverbinding of zelfs je data van je apparaat hoeft te halen? Dankzij een reeks lichtgewicht, compacte apps en modellen is dit nu al mogelijk.

Ik heb het zelf geprobeerd en dit is wat je moet weten.

Voer AI lokaal uit op de iPhone

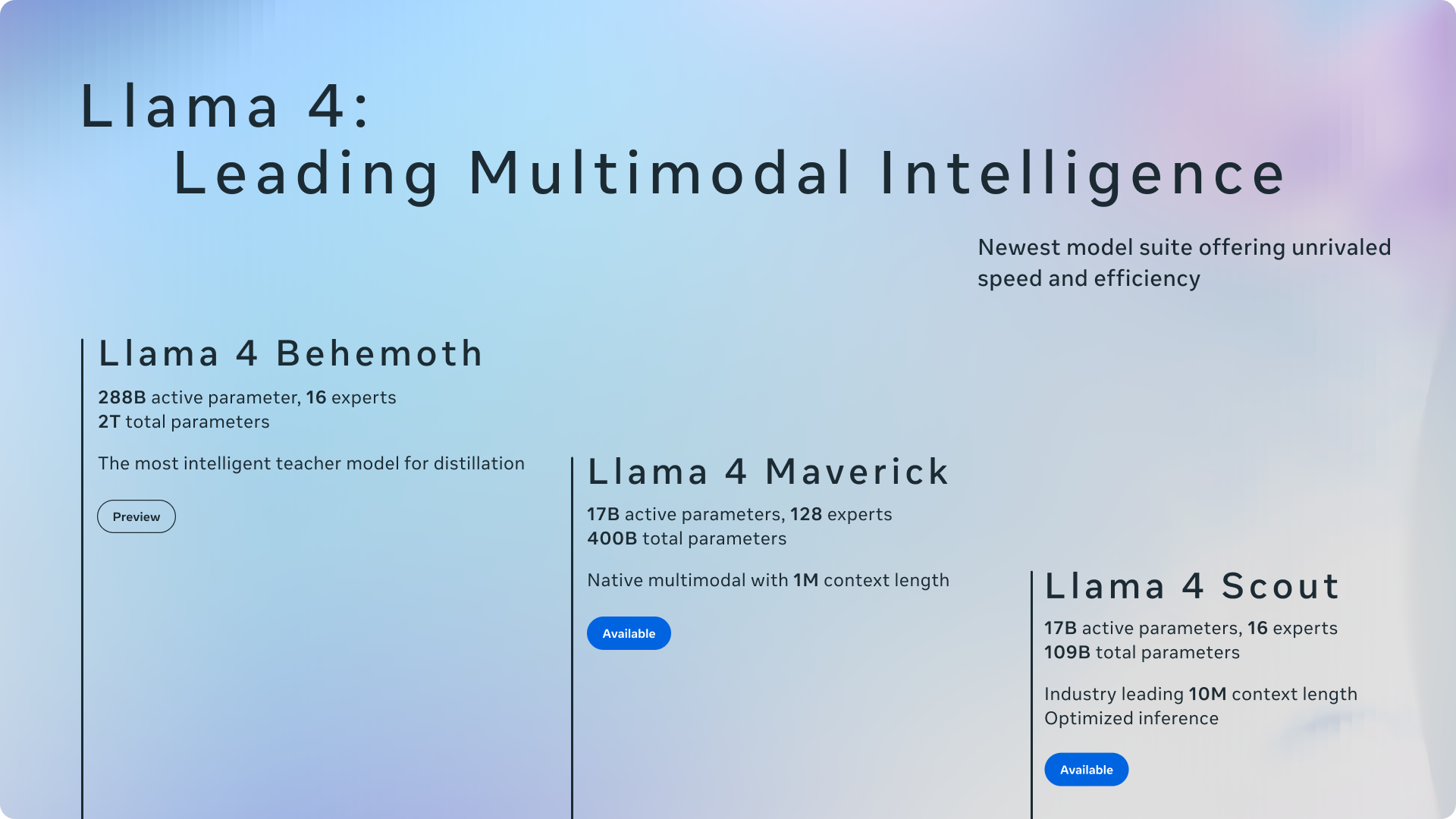

U kunt nu open source-modellen uitvoeren zoals Lama و Qwen Direct op iOS. Deze modellen worden verkleind met behulp van een proces genaamd kwantificering, waarbij ze worden gecomprimeerd zodat ze in het mobiele geheugen passen zonder de prestaties significant te beïnvloeden.

Maar er is één belangrijk punt: de prestaties zijn sterk afhankelijk van je apparaat. Zo kan de iPhone 15 Pro of 15 Pro Max, uitgerust met Apple's nieuwste chip, modellen aan met wel 7 of 8 miljard parameters (zoals de Llama 3.1 8B), terwijl oudere telefoons meer geschikt zijn voor kleinere modellen met parameters tussen de 1 en 3 miljard.

Apps die het mogelijk maken

- LLM Farm (gratis): De makkelijkste manier om te beginnen. Je kunt een klein model (zoals Phi-3.5 Instruct) downloaden en met één klik offline uitvoeren. Het werkt verrassend soepel voor snelle query's.

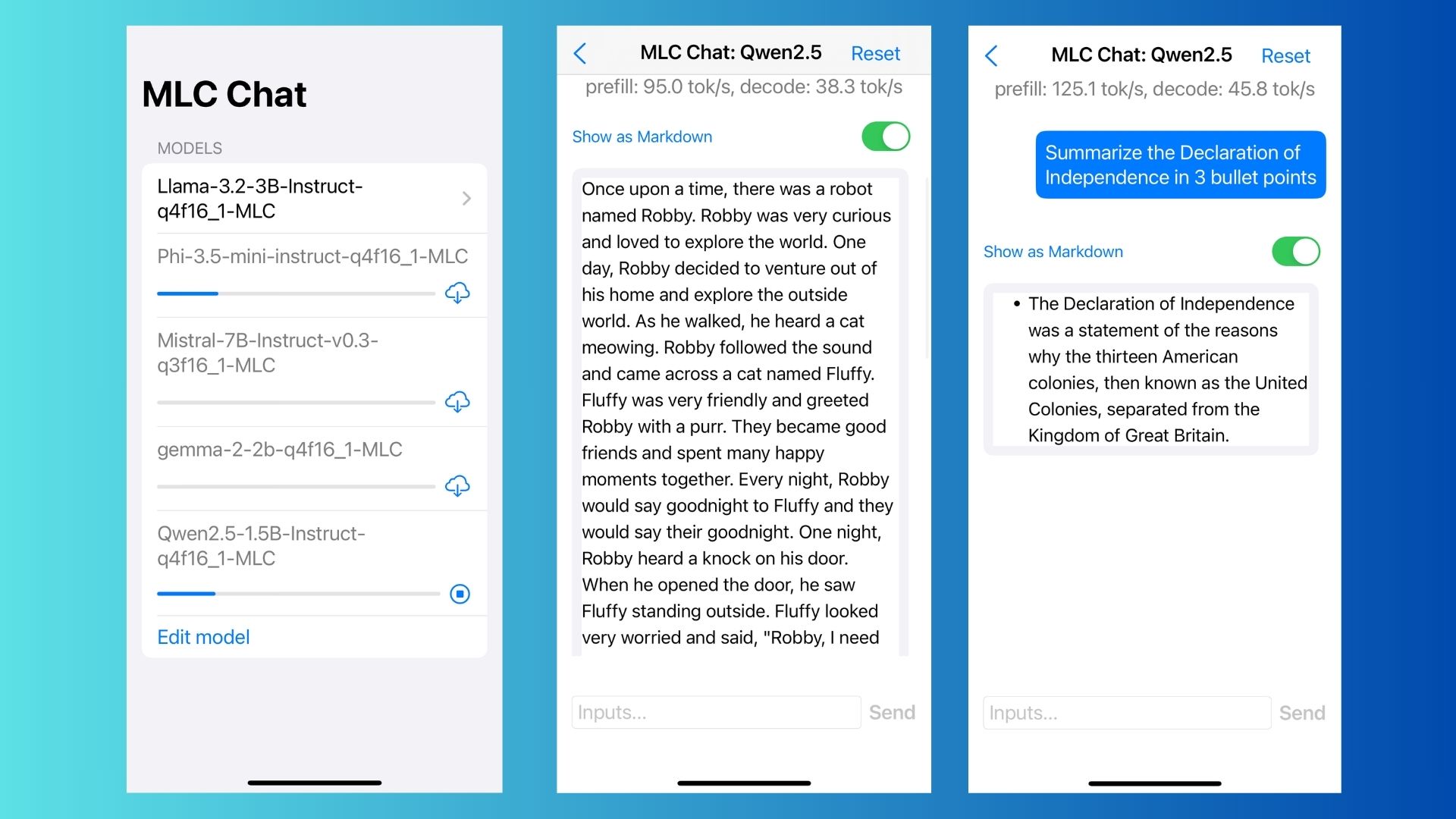

- MLC Chat (gratis):

Dit is de app die ik heb gebruikt. Ik wilde LLM Farm uitproberen, maar om de een of andere reden was hij niet te downloaden in de Apple App Store. Omdat hij gratis is, heb ik hem geprobeerd en hij werkte perfect. - Privé LLM (Community Project): Deze optie is meer een doe-het-zelfproject dan geschikt voor de gemiddelde gebruiker. Deze app bevat gedetailleerde handleidingen voor het downloaden van modellen zoals Llama 3.1 en Qwen naar je iPhone. Als je van knutselen en experimenteren houdt, is het zeker het proberen waard.

- Apollo (Betaald): Ik heb er goede dingen over gehoord, maar ik heb het zelf nog niet geprobeerd. Laat me in de reacties weten wat je van deze privacygerichte app vindt.

Hoe het model lokaal kan worden uitgevoerd

Nadat je de app van je keuze hebt gedownload, open je deze. Blader door de lijst met ingebouwde modellen en selecteer er een (bijvoorbeeld Phi-3.5 Instruct Q4 quantized). Ik heb voor Qwen 2.5 gekozen, simpelweg omdat ik die al een tijdje niet meer had gebruikt.

Na het downloaden zie je het formulier op je apparaat (de grootte varieert van een paar honderd megabyte tot enkele gigabyte). Vanaf daar kun je gewoon beginnen met chatten.

Wees realistisch; dit is niet het moment om om diepgaande analyses of lange, gedetailleerde plannen te vragen. Denk aan het volgende:

- de snelheid: Kleine modellen (1-3 miljard parameters) reageren sneller, terwijl grote modellen seconden per symbool nodig kunnen hebben.

- Context: Plak geen hele artikelen; houd de prompts korter.

- Uitvoer: Lokale, grote taalmodellen zijn mogelijk minder nauwkeurig dan ChatGPT, maar ze zijn wel handig voor het maken van aantekeningen, samenvattingen, vraag-en-antwoordsessies en het maken van kleine concepten.

Ik vond het leuk om een aantal prompts uit te proberen. Niets ingewikkelds; ik wilde gewoon zien wat voor reacties ik kreeg op de lokale aanvraag. Wat je meteen opvalt, is de snelheid. Het is verbazingwekkend hoe snel een groot taalmodel reageert.

Ik heb de volgende beweringen geprobeerd en over het algemeen waren de resultaten mij bevallen.

- Vat de Onafhankelijkheidsverklaring samen in drie punten.

- “Schrijf een kort verhaaltje voor het slapengaan over een robot en een kat.”

- “Geef me drie ideeën voor het avondeten met kip, rijst en broccoli.”

Het uitvoeren van een groot lokaal taalmodel is niet hetzelfde als chatten met Chatten GPT-5Het voelt inderdaad simplistisch en grof aan. Als je dit probeert, houd er dan rekening mee dat je de prompts kort moet houden, aangezien de contextvensters veel beperkter zijn dan bij de reguliere chatbotversie. Je zult merken dat de reacties trager zijn als je het lokale, grote taalmodel overbelast.

Waarom zou je dat doen?

- Er zijn geen abonnementskosten. Je hoeft niet al je krediet te verbruiken om het te proberen.

- Ingebouwde privacy. Alles blijft op uw apparaat staan.

- Verrassend veelzijdig. Ik was echt verbaasd over de hoeveelheid taken die de miniatuur aankon. Telkens als ik zijn grenzen testte, kon hij de uitdaging met gemak aan.

het komt neer op

Als je een iPhone 15 of nieuwer hebt en wilt ontdekken hoe AI er 'van binnenuit' uitziet, begin dan daar. LLM Farm أو MLCChat Snelle en gratis manieren om aan de slag te gaan. Als je privacy belangrijk vindt, is de app Apollo Het proberen waard. Als je van experimenteren en personaliseren houdt, Privé LLM Hiermee kunt u dieper ingaan op aangepaste instellingen.

Onthoud dat dit niet de volwaardige chatbots zijn die je gewend bent, dus verwacht geen ChatGPT-achtige output. Maar het is best cool en futuristisch om je eigen AI op je iPhone te draaien.

Reacties zijn gesloten.