Meta leert AI-modellen de kunst om onderscheid te maken tussen belangrijke opdrachten en andere opdrachten.

Redeneermodellen zoals OpenAI o1 en DeepSeek-R1 hebben last van overdenken. Als je haar een simpele vraag stelt, zoals: "Wat is 1+1?", zal ze enkele seconden nadenken voordat ze antwoordt.

Idealiter zouden AI-modellen, net als mensen, moeten kunnen bepalen wanneer ze direct antwoord moeten geven en wanneer ze extra tijd en middelen moeten vrijmaken om na te denken voordat ze reageren. En dat doet het ook Nieuwe technologie Gepresenteerd door onderzoekers in Meta-AI وUniversiteit van Illinois in Chicago Door modellen te trainen om inferentiebudgetten toe te wijzen op basis van de moeilijkheidsgraad van de query. Het resultaat is snellere reacties, lagere kosten en een betere toewijzing van computerbronnen.

kostbare redenering

Grote taalmodellen (LLM's) kunnen hun prestaties bij redeneertaken verbeteren wanneer ze langere gedachteketens produceren, vaak bekend als 'gedachteketens' (CoT). Het succes van de ideeënketentechniek heeft geleid tot een hele reeks technieken voor het schalen van de inferentietijd. Deze technieken dwingen het model om dieper over het probleem na te denken, meerdere antwoorden te genereren en te beoordelen, en het beste antwoord te kiezen.

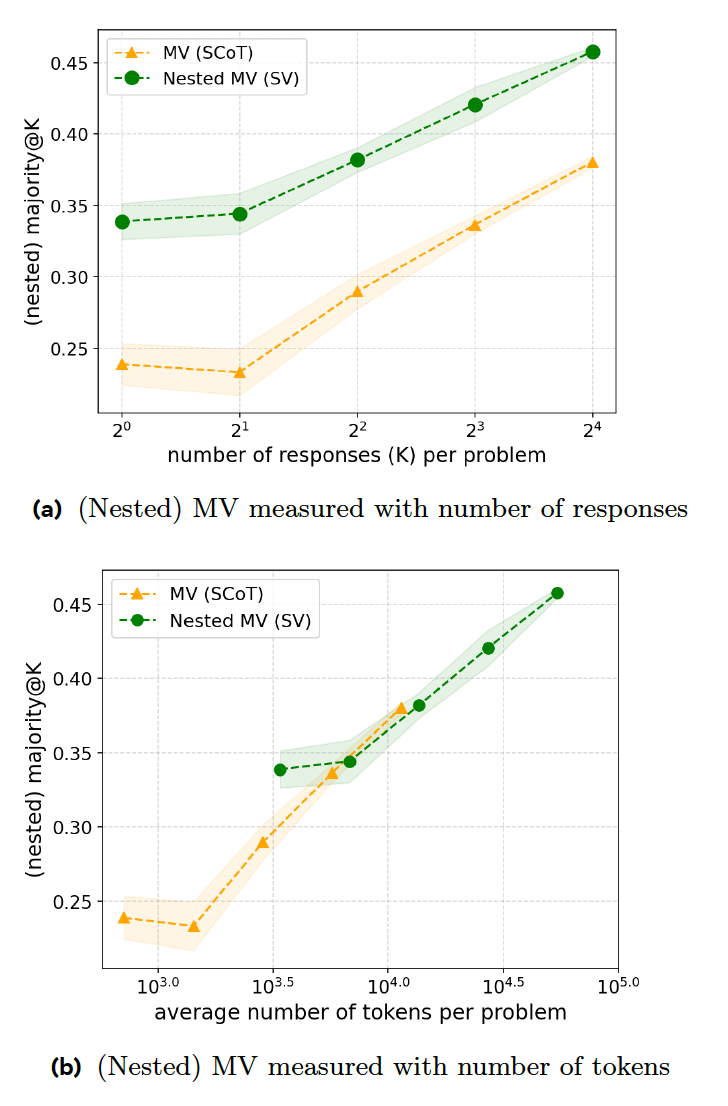

Meerderheidsstemmen (MV) is een van de belangrijkste methoden die in redeneermodellen wordt gebruikt, waarbij meerdere antwoorden worden gegenereerd en het meest gestelde antwoord wordt gekozen. Het probleem met deze aanpak is dat het model een uniform gedrag aanneemt, waarbij elke invoer als een moeilijk redeneerprobleem wordt behandeld en onnodige bronnen worden verbruikt om meerdere antwoorden te genereren.

Intelligent redeneren

In het nieuwe onderzoeksartikel wordt een reeks trainingstechnieken voorgesteld waarmee redeneermodellen efficiënter kunnen reageren. De eerste stap is ‘sequentieel stemmen’ (SV), waarbij het model het redeneringsproces afbreekt zodra een bepaald antwoord een bepaald aantal keer is voorgekomen. U moet bijvoorbeeld maximaal acht antwoorden geven en het antwoord kiezen dat minimaal drie keer voorkomt. Als aan het model de bovenstaande eenvoudige vraag wordt gesteld, is de kans groot dat de eerste drie antwoorden op elkaar lijken. Dit leidt tot een vroegtijdige stop, wat tijd en computerbronnen bespaart.

Uit hun experimenten blijkt dat SV beter presteert dan de klassieke MV bij wiskundewedstrijden als het hetzelfde aantal antwoorden genereert. SV vereist echter aanvullende instructies en codegeneratie, waardoor het qua code-precisieverhouding vergelijkbaar is met MV.

De tweede techniek, Adaptive Sequential Voting (ASV), verbetert SV door het model te dwingen het probleem te onderzoeken en alleen meerdere antwoorden te genereren als het probleem moeilijk is. Bij eenvoudige problemen (zoals een 1+1-stelling) genereert het model simpelweg één antwoord, zonder dat er een stemmingsproces plaatsvindt. Hierdoor is het model efficiënter bij het aanpakken van zowel eenvoudige als complexe problemen.

Versterking leren

Hoewel de SV- en ASV-technieken de efficiëntie van het model verbeteren, vereisen ze een grote hoeveelheid handmatig gelabelde gegevens. Om dit probleem te verhelpen, stellen de onderzoekers ‘inference budget-constrained policy optimization’ (IBPO) voor, een reinforcement learning-algoritme dat het model leert de lengte van redeneerpaden aan te passen op basis van de moeilijkheidsgraad van de query.

IBPO is ontworpen om grote taalmodellen (LLM's) in staat te stellen hun antwoorden te verbeteren en tegelijkertijd binnen de beperkingen van het inferentiebudget te blijven. Dankzij het reinforcement learning-algoritme kan het model de winst die is behaald met trainen op handmatig gelabelde gegevens overtreffen door voortdurend ASV-trajecten te genereren, reacties te evalueren en uitkomsten te selecteren die het juiste antwoord en het optimale inferentiebudget opleveren.

Uit hun experimenten blijkt dat IBPO het Pareto-front verbetert. Dit betekent dat een model dat is getraind met IBPO, bij een vast inferentiebudget, beter presteert dan andere basislijnen.

Deze bevindingen komen op een moment waarop onderzoekers waarschuwen dat de huidige AI-modellen het moeilijk hebben. Bedrijven hebben moeite om hoogwaardige trainingsgegevens te vinden en zoeken naar alternatieve manieren om hun modellen te verbeteren.

Een veelbelovende oplossing is reinforcement learning, waarbij het model een doel krijgt en zelf oplossingen mag vinden. Dit in tegenstelling tot supervised fine-tuning (SFT), waarbij het model wordt getraind met handmatig gelabelde voorbeelden.

Verrassend genoeg vindt het model vaak oplossingen waar mensen zelf niet aan hadden gedacht. Het lijkt erop dat deze formule heeft gewerkt bij DeepSeek-R1, waarmee de dominantie van Amerikaanse AI-labs werd uitgedaagd.

De onderzoekers merken op dat "prompt-gebaseerde methoden en SFT worstelen met absolute optimalisatie en efficiëntie, wat de veronderstelling ondersteunt dat SFT op zichzelf geen zelfcorrigerende mogelijkheden biedt. Deze observatie wordt ook ondersteund door gelijktijdig onderzoek, wat suggereert dat dit zelfcorrigerende gedrag spontaan ontstaat tijdens RL in plaats van handmatig gegenereerd te worden door prompts of SFT."

Reacties zijn gesloten.