Telefoongeheimen die AI-enthousiastelingen nodig hebben: Gemini en ChatGPT tot het uiterste benutten

Een van de meest opvallende – en eerlijk gezegd ook meest saaie – trends in de smartphonebranche van de afgelopen twee jaar is het voortdurende gepraat over AI-ervaringen. Vooral siliciumbedrijven scheppen er vaak over op dat hun nieuwste mobiele processoren AI-bewerkingen op het apparaat zelf, zoals het maken van video's, mogelijk maken.

We zijn er al, maar nog niet helemaal. Te midden van alle hype rondom AI-trucs die voor smartphonegebruikers teleurstellend zijn, gaat de discussie zelden verder dan flitsende demonstraties van nieuwe processors en voortdurend evoluerende chatbots.

Pas toen de afwezigheid van Gemini Nano in de Google Pixel 8 voor ophef zorgde, besefte het publiek hoe belangrijk RAM-capaciteit is voor AI op mobiele apparaten. Apple maakte ook snel duidelijk dat Apple Intelligence alleen beschikbaar zou blijven voor apparaten met minimaal 8 GB RAM. Deze beslissing onderstreept het belang van RAM voor het efficiënt uitvoeren van AI-modellen.

Maar het beeld van een ‘AI-telefoon’ gaat niet alleen over geheugencapaciteit. Hoe goed uw telefoon AI-gestuurde taken uitvoert, hangt ook af van onzichtbare RAM-optimalisaties en opslag. En nee, ik heb het niet alleen over capaciteit.

Innovaties op het gebied van geheugen komen naar AI-telefoons.

Digital Trends sprak met Micron, een wereldleider in geheugen- en opslagoplossingen, om de rol van RAM en opslag in AI-bewerkingen op smartphones te analyseren. Houd de ontwikkelingen van Micron in de gaten de volgende keer dat u op zoek bent naar een premium telefoon.

De nieuwste producten van het bedrijf uit Idaho zijn onder meer G9 NAND mobiele UFS 4.1-opslag en 1γ (1-gamma) LPDDR5X RAM-modules voor toonaangevende smartphones. Hoe verbeteren geheugenoplossingen AI op smartphones, naast het vergroten van de capaciteit?

Laten we beginnen met de NAND UFS 9-opslagoplossing van de G4.1. De belangrijkste beloften zijn een zuinig stroomverbruik, lagere latentie en een hoge bandbreedte.. De UFS 4.1-standaard kan maximale sequentiële lees- en schrijfsnelheden bereiken van 4100 MB/s, een toename van 15% ten opzichte van de UFS 4.0-generatie, terwijl ook de latentiecijfers worden verlaagd.

Een ander belangrijk voordeel is dat de volgende generatie draagbare opslagunits van Micron beschikbaar zijn met een capaciteit tot wel 2 TB. Bovendien is Micron erin geslaagd de omvang ervan te verkleinen, waardoor het een ideale oplossing is voor opvouwbare telefoons en slanke telefoons van de volgende generatie, zoals Samsung Galaxy Edge S25.

Wat betreft RAM-ontwikkelingen heeft Micron de 1γ LPDDR5X RAM-modules ontwikkeld. De processor haalt een topsnelheid van 9200 MT/s, kan dankzij het kleinere formaat 30% meer transistoren bevatten en verbruikt tegelijkertijd 20% minder stroom. Micron heeft al de iets tragere 1β (1-beta) RAM-oplossing geïntroduceerd die in de Samsung Galaxy S25-serie smartphones zit.

De interactie tussen opslag en kunstmatige intelligentie

Ben Rivera, directeur productmarketing voor de mobiele bedrijfseenheid van Micron, legde uit dat Micron vier belangrijke verbeteringen heeft doorgevoerd in zijn nieuwste opslagoplossingen om snellere AI-bewerkingen op mobiele apparaten te garanderen. Deze verbeteringen omvatten Zoned UFS, Data Defragmentation, Pinned WriteBooster en Intelligent Latency Tracker.

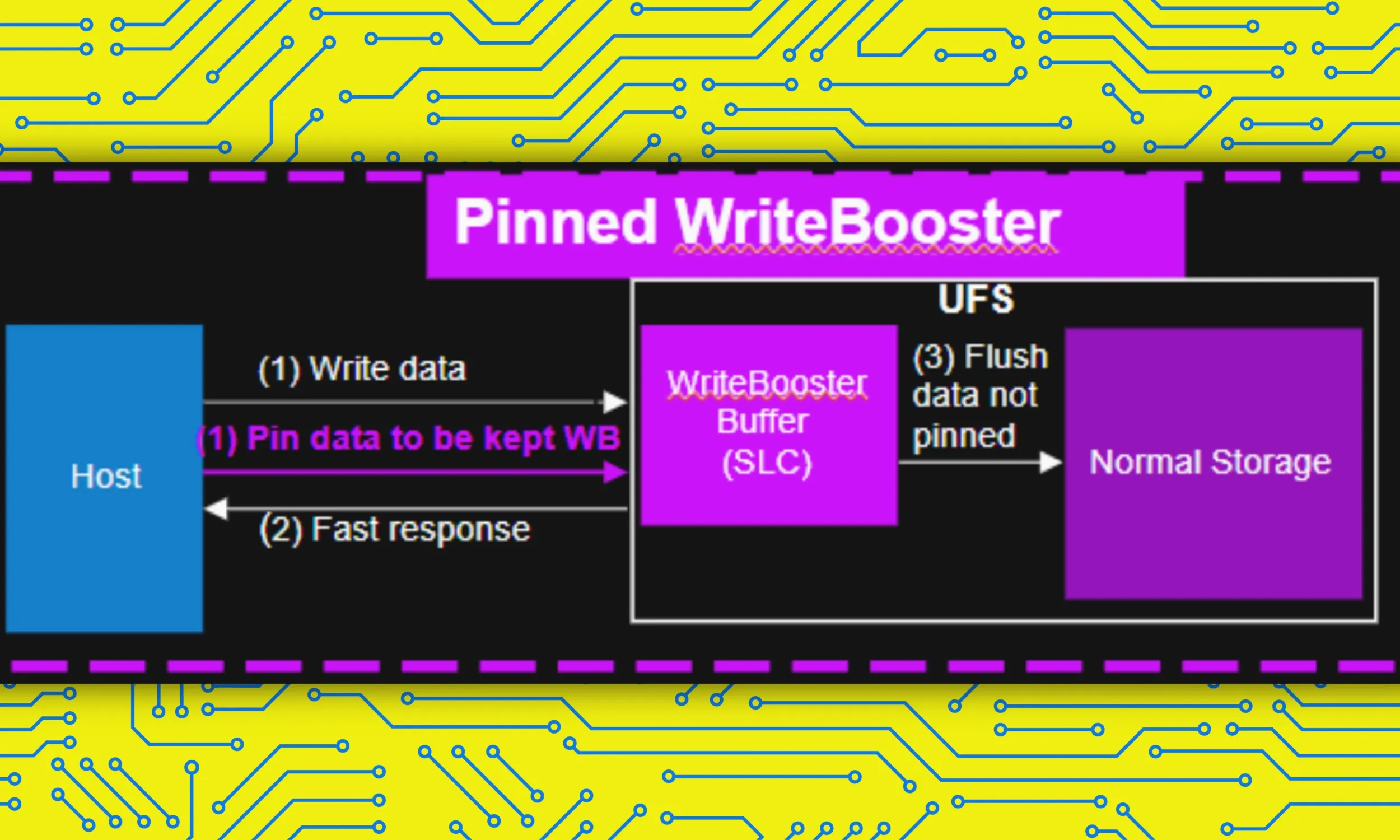

"Met deze functie kan de processor of host de meest gebruikte gegevens op de smartphone identificeren en isoleren of 'vastpinnen' op een gebied van het opslagapparaat dat de WriteBooster-buffer wordt genoemd (vergelijkbaar met een cache), zodat er snel en onmiddellijk toegang toe is", legt Rivera uit over de Pinned WriteBooster-functie.

Elk AI-model, zoals Google Gemini of ChatGPT, dat taken op een apparaat wil uitvoeren, heeft een eigen set instructiebestanden nodig die lokaal op het mobiele apparaat worden opgeslagen. Je hebt bijvoorbeeld nodig Apple Intelligence tot 7 GB opslagruimte Voor al haar activiteiten.

Om een taak uit te voeren, kunt u niet de gehele AI-stack delegeren aan RAM, omdat er ruimte nodig is om andere belangrijke taken te verwerken, zoals bellen of communiceren met andere belangrijke applicaties. Om de beperkingen van Micron-opslag aan te pakken, wordt een geheugenkaart gemaakt die alleen de vereiste AI-gewichten vanuit de opslag in het RAM laadt.

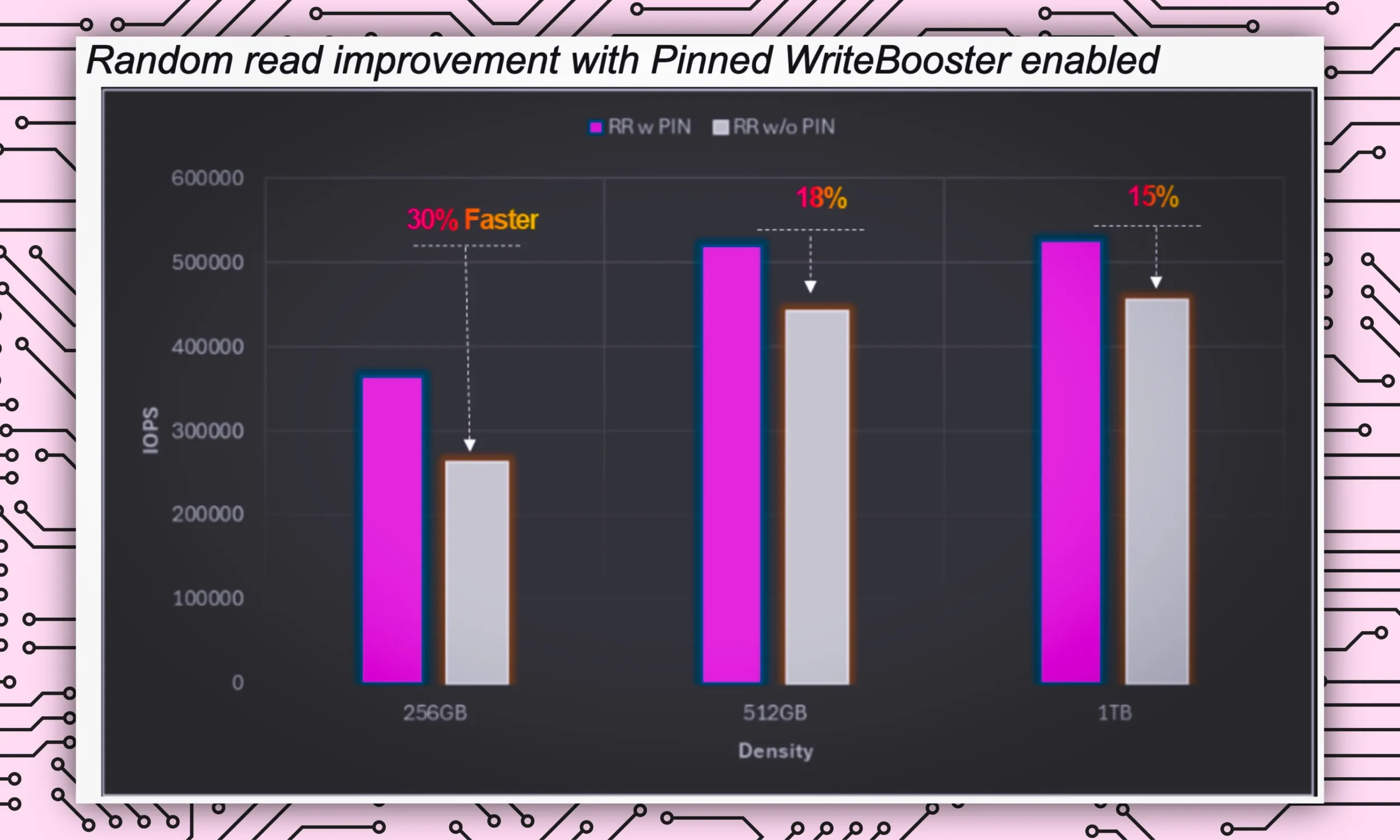

Wanneer de bronnen beperkt zijn, hebt u behoefte aan snellere gegevensuitwisseling en -lezing. Zo weet u zeker dat uw AI-taken worden uitgevoerd zonder dat dit de snelheid van andere belangrijke taken beïnvloedt. Dankzij Pinned WriteBooster wordt deze gegevensuitwisseling met 30% versneld, waardoor AI-taken zonder vertraging worden verwerkt.

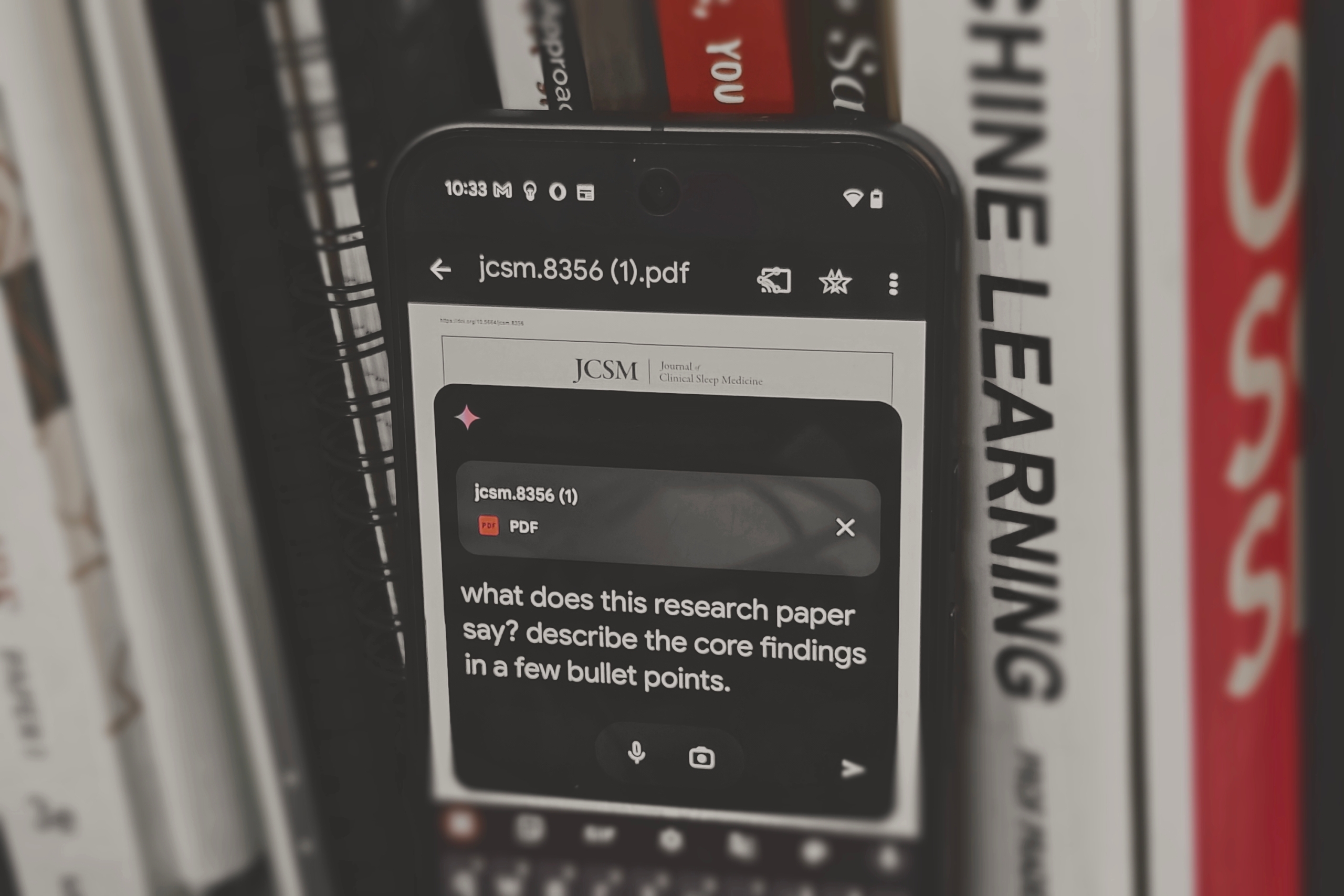

Stel dat je het nodig hebt Gemini om PDF-bestand te extraheren voor analyse. Dankzij snelle geheugenuitwisseling worden vereiste AI-gewichten snel van de opslag naar het RAM-geheugen overgebracht.

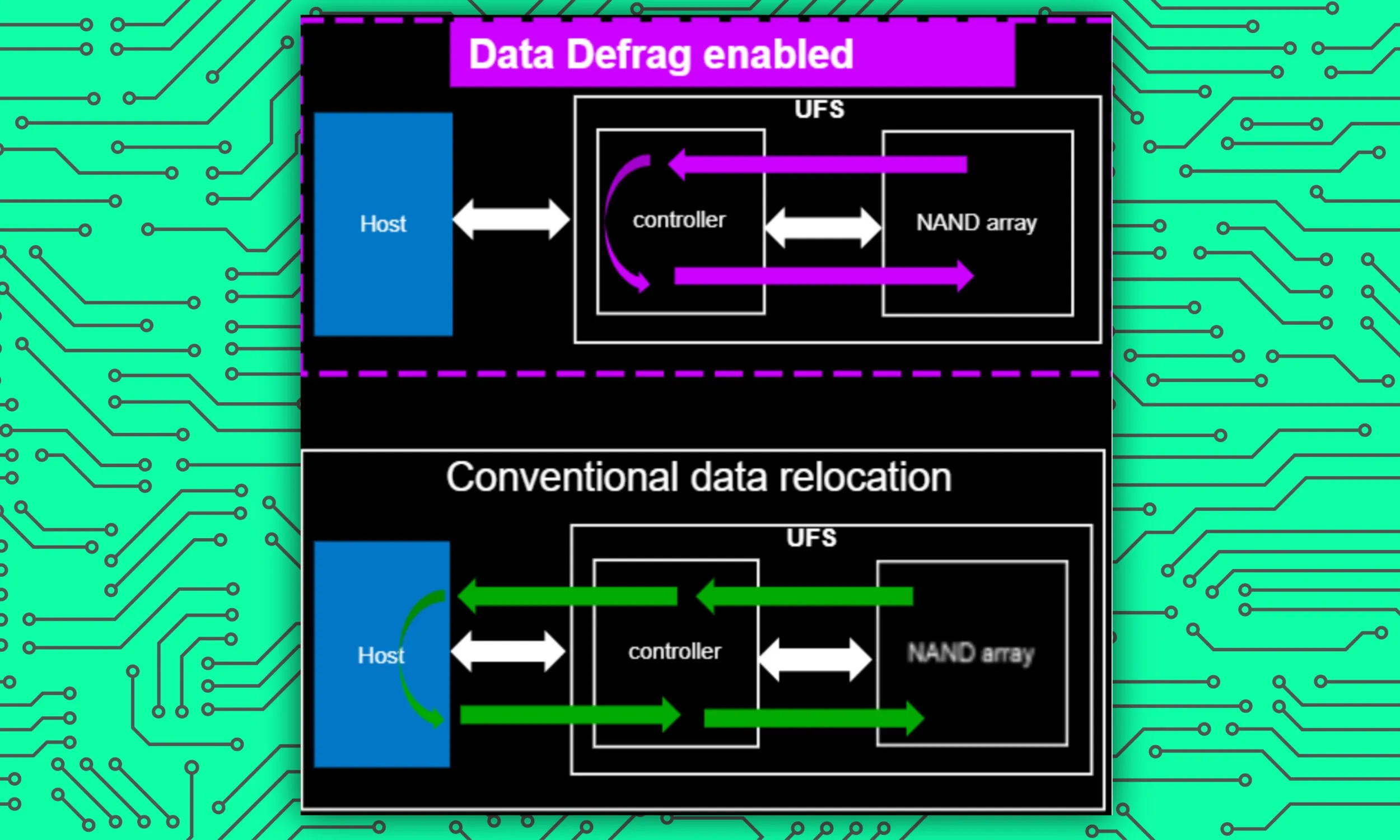

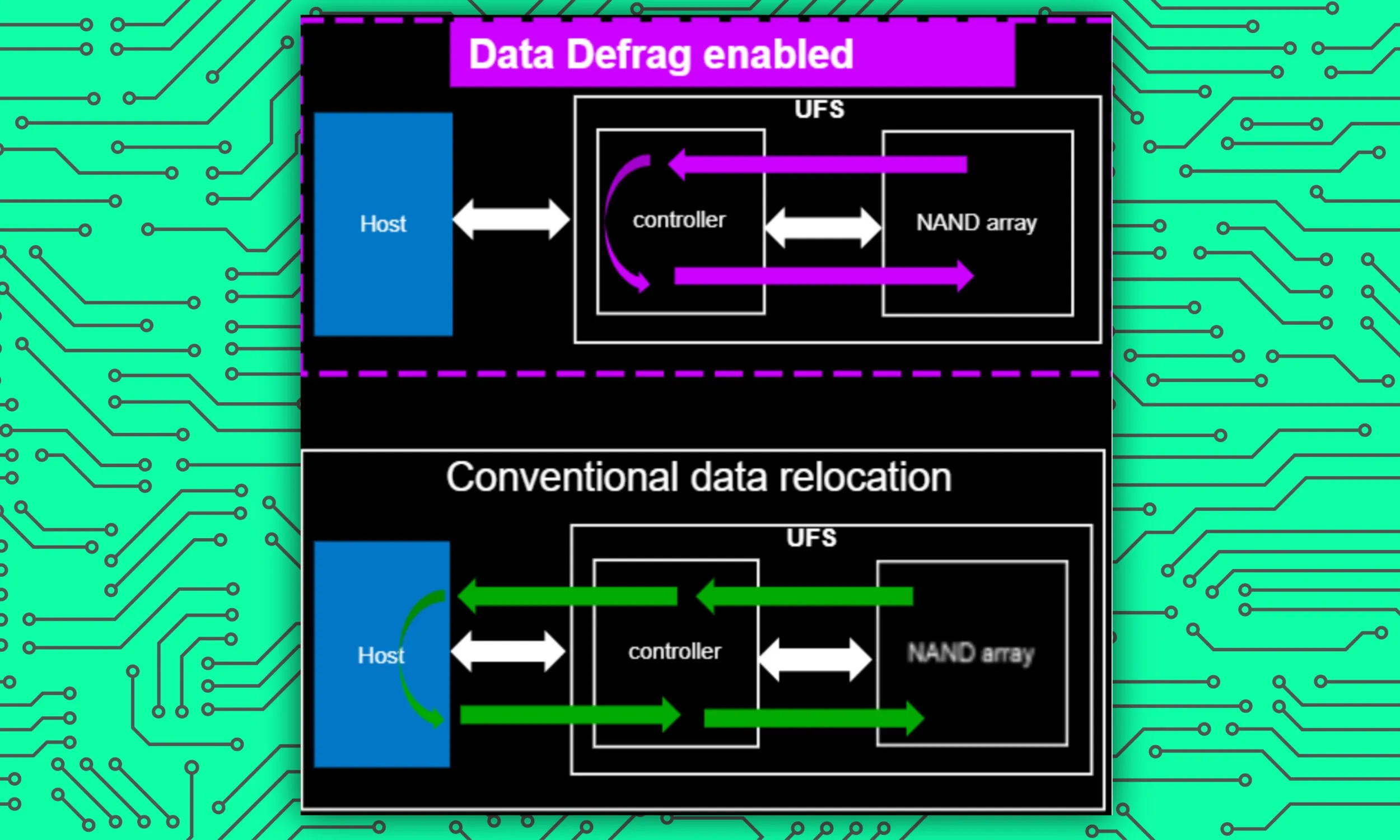

Vervolgens hebben we Data Defrag. U kunt het zien als een bureau- of kastorganizer waarmee u ervoor zorgt dat voorwerpen netjes worden gegroepeerd in verschillende categorieën en in hun eigen kastjes worden geplaatst, zodat ze gemakkelijk te vinden zijn.

In de context van smartphones worden weliswaar grote hoeveelheden gegevens gedurende een lange gebruiksperiode opgeslagen, maar meestal gebeurt dit op een enigszins willekeurige manier. Het netto-effect is dat wanneer het ingebouwde systeem toegang moet krijgen tot een bepaald type bestand, het moeilijker wordt om alle bestanden te vinden, wat resulteert in een tragere werking.

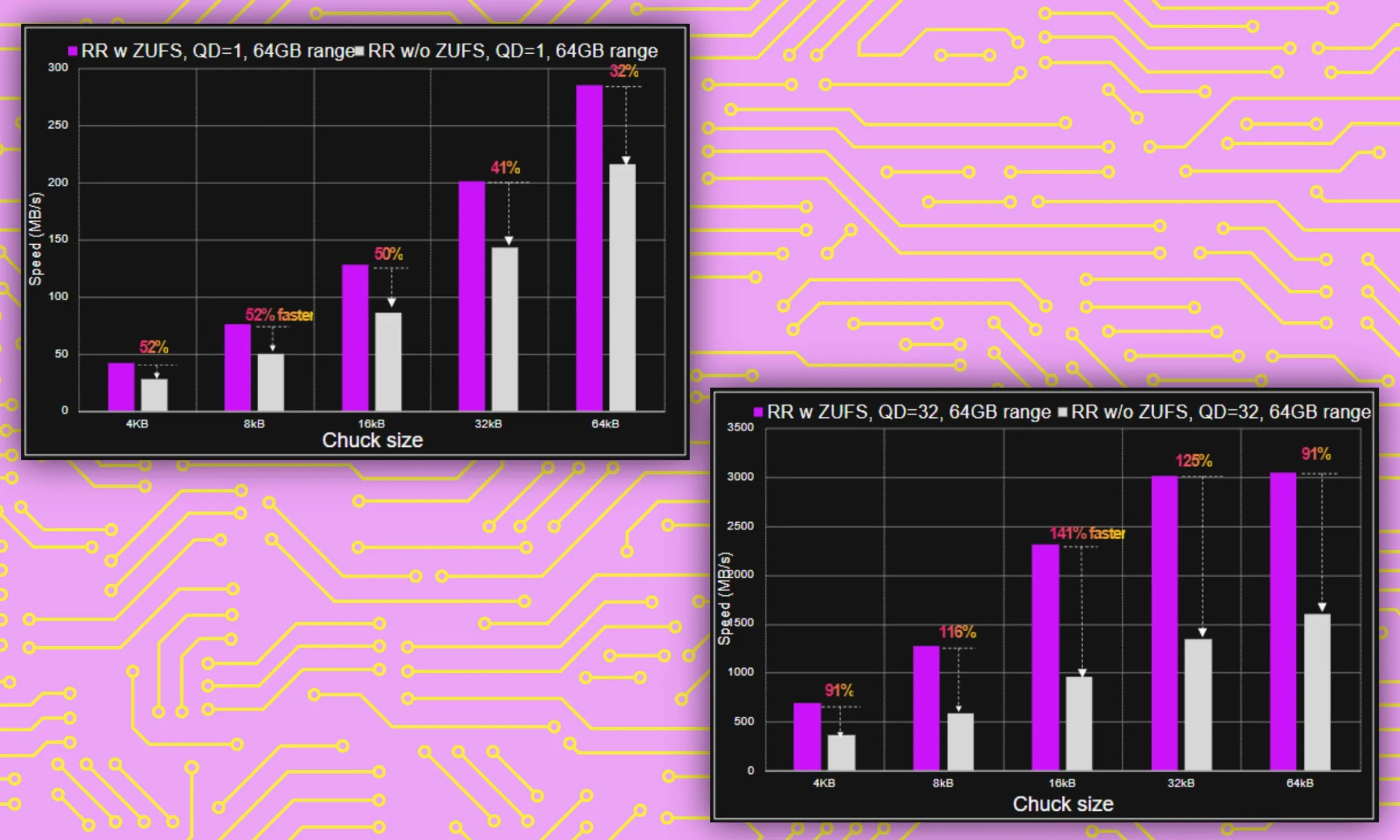

Volgens Rivera zorgt Data Defrag niet alleen voor een georganiseerde gegevensopslag, maar verandert het ook de manier waarop het opslagapparaat samenwerkt met de controller van het apparaat. Zo is het Verhoogt de leessnelheid van gegevens met een verbazingwekkende 60%waardoor alle soorten interacties tussen gebruiker en apparaat, waaronder AI-taken, op natuurlijke wijze worden versneld.

"Deze functie kan helpen AI-functies te versnellen, bijvoorbeeld wanneer een generatief AI-model, zoals een model dat wordt gebruikt om een afbeelding te genereren uit een tekstprompt, van de opslag naar het geheugen wordt aangeroepen, waardoor gegevens sneller van de opslag naar het geheugen kunnen worden gelezen", vertelde een functionaris van Micron aan Digital Trends.

Intelligence Latency Tracker is een andere functie die in principe latentiegebeurtenissen en factoren in de gaten houdt die de normale snelheid van uw telefoon kunnen vertragen. Later helpt het bij het corrigeren van fouten en het verbeteren van de prestaties van de telefoon, zodat normale taken en AI-taken geen vertragingen ondervinden.

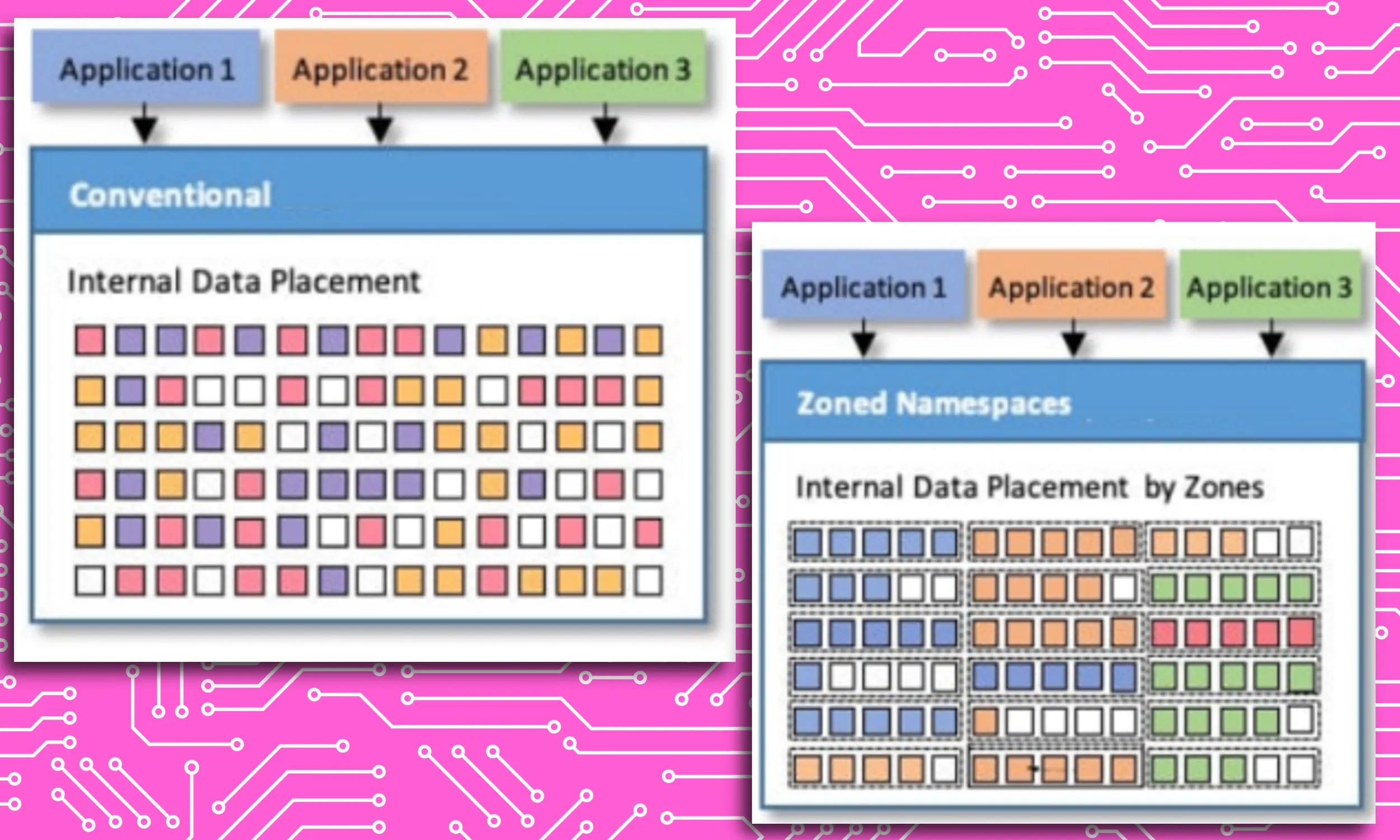

De laatste opslagverbetering is Zoned UFS. Dit systeem zorgt ervoor dat gegevens met vergelijkbare invoer-/uitvoergegevens op een georganiseerde manier worden opgeslagen. Dit is erg belangrijk omdat het systeem hierdoor makkelijker de benodigde bestanden kan vinden. Zo verspilt u geen tijd aan het doorzoeken van alle mappen en directories.

"De ZUFS-functie van Micron helpt bij het organiseren van gegevens, zodat wanneer het systeem specifieke gegevens voor een taak moet vinden, het proces sneller en soepeler verloopt", vertelde Rivera ons.

RAM-overloop

Voor AI-workflows heb je een bepaalde hoeveelheid RAM nodig. Hoe meer capaciteit, hoe beter. Hoewel Apple de basis voor zijn Apple Intelligence-suite op 8 GB heeft gezet, zijn spelers in het Android-ecosysteem overgestapt op 12 GB als veilige standaard. Waarom?

"AI-ervaringen zijn bovendien data-intensief en energie-intensief", legt Rivera uit. "Om de belofte van AI waar te maken, moeten geheugen en opslag een lage latentie en hoge prestaties leveren met maximale energie-efficiëntie."

Met zijn volgende generatie 5γ (1-gamma) LPDDR1X DRAM-oplossing voor smartphones is Micron erin geslaagd de bedrijfsspanning van geheugenmodules te verlagen. Dan is er nog de zeer belangrijke vraag van de lokale prestaties. Volgens Rivera kunnen de nieuwe geheugenmodules werken met snelheden tot 9.6 gigabits per seconde, wat zorgt voor uitstekende AI-prestaties.

Volgens Micron hebben verbeteringen aan het extreem ultraviolet (EUV) lithografieproces niet alleen de deur geopend naar hogere snelheden, maar ook naar een flinke sprong voorwaarts van 20% in energie-efficiëntie.

De weg naar meer gepersonaliseerde AI-ervaringen?

De volgende generatie RAM- en opslagoplossingen van Micron voor smartphones zijn niet alleen gericht op verbeterde AI-prestaties, maar ook op de algehele versnelling van uw dagelijkse smartphonetaken. Ik vroeg me af of de verbeterde mobiele NAND UFS 9-opslag van de G4.1 en het 1γ (1-gamma) LPDDR5X RAM ook offline AI-processors zouden versnellen.

Zowel smartphonefabrikanten als AI-labs stappen steeds vaker over op lokale AI-verwerking. Dit betekent dat de workflow lokaal op uw telefoon wordt uitgevoerd, in plaats van dat uw query's naar een cloudserver worden gestuurd waar het proces wordt verwerkt, waarna het resultaat via een internetverbinding naar uw telefoon wordt verzonden.

Van het transcriberen van telefoongesprekken en spraakmemo's tot het verwerken van complexe onderzoeksmaterialen naar PDF's: alles gebeurt op uw telefoon. Er verlaten geen persoonlijke gegevens uw apparaat. Het is een veiligere en snellere aanpak, maar vereist tegelijkertijd wel krachtige systeembronnen. Een snellere, efficiëntere geheugenmodule is een van deze essentiële vereisten.

Kunnen de volgende generatie oplossingen van Micron bijdragen aan een lokale aanpak van AI? Dat kan zij. Het versnelt zelfs processen waarvoor een cloudverbinding nodig is, zoals het maken van video's via het Veo-model van Google. Hiervoor zijn nog steeds krachtige servers nodig.

"Een native AI-applicatie die rechtstreeks op het apparaat draait, zal het meeste verkeer genereren, omdat deze niet alleen gebruikersgegevens van het opslagapparaat leest, maar ook AI-inferentie op het apparaat uitvoert", aldus Rivera. "In dit geval zullen onze functies helpen de gegevensstroom voor beide te optimaliseren."

Wanneer kunt u verwachten dat telefoons met de nieuwste oplossingen van Micron in de winkels liggen? Rivera zegt dat alle grote smartphonefabrikanten de volgende generatie RAM en opslagmodules van Micron zullen omarmen. Wat betreft markttoegang zouden de belangrijkste modellen die eind 2025 of begin 2026 op de markt komen, op uw winkelradar moeten staan.

Reacties zijn gesloten.