OpenAI reageert op DeepSeek-competitie met gedetailleerde technologie voor het volgen van gedachten voor de o3-mini

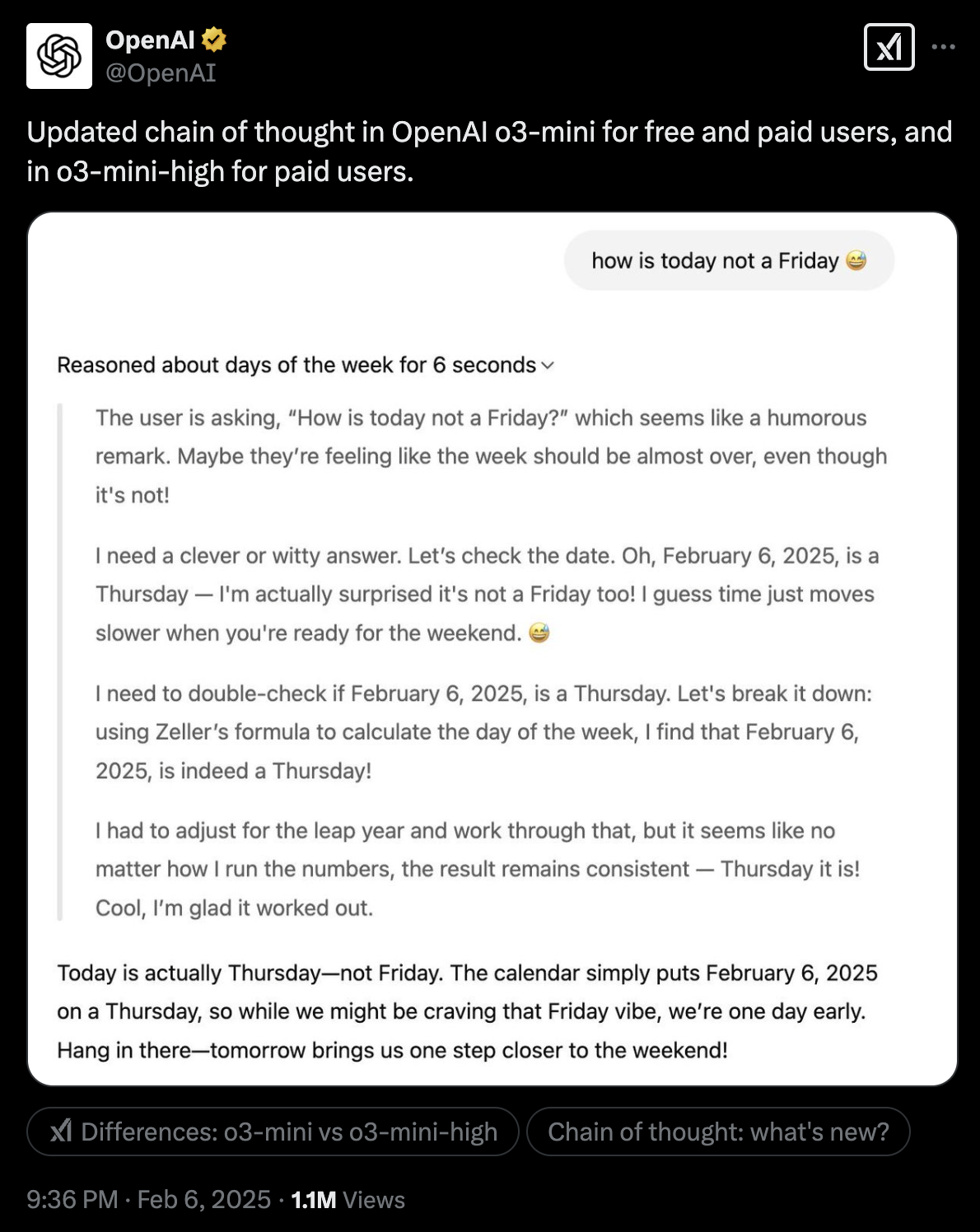

OpenAI onthult nu meer details over het redeneerproces van zijn nieuwste denkmodel, o3-mini. Deze verandering werd aangekondigd op OpenAI's account op het X-platformDit komt omdat het AI-lab steeds meer onder druk komt te staan van DeepSeek-R1, een concurrerend open-sourcemodel dat de denkcode volledig weergeeft.

Modellen zoals o3 en R1 doorlopen een langdurig proces van de 'ideeënketen' (CoT), waarbij u extra codes maakt om het probleem op te splitsen, verschillende antwoorden bedenkt en test, en tot een definitieve oplossing komt. Voorheen verborgen de redeneermodellen van OpenAI hun denkproces en gaven ze alleen een globaal overzicht van de redeneerstappen. Hierdoor werd het voor gebruikers en ontwikkelaars lastig om de redenering van het model te begrijpen en hun instructies en prompts aan te passen om het model in de juiste richting te sturen.

OpenAI beschouwde de ideeënpijplijn als een concurrentievoordeel en verborg deze om te voorkomen dat concurrenten deze zouden kopiëren om hun modellen te trainen. Maar omdat R1 en andere open source-modellen het volledige redeneringsproces demonstreren, is het gebrek aan transparantie een nadeel voor OpenAI geworden.

De nieuwe o3-mini toont een meer gedetailleerde versie van de Ideas-serie. Hoewel we de eerste symbolen nog niet zien, verschaffen ze meer duidelijkheid over het denkproces.

Waarom is dit belangrijk voor toepassingen?

Uit eerdere experimenten met de O1- en R1-modellen bleek dat O1 iets beter was in het oplossen van problemen met data-analyse en redenering. Een belangrijke beperking was echter dat er geen manier was om erachter te komen waarom het model fouten maakte. Bovendien maakte het vaak fouten als het werd gebruikt met rommelige, echte data van internet. Aan de andere kant zorgde het R1-denkproces ervoor dat we problemen konden oplossen en onze prompts konden aanpassen om ons denken te verbeteren.

In één van onze experimenten konden beide modellen bijvoorbeeld niet het juiste antwoord geven. Dankzij de gedetailleerde inzichten van R1 konden we ontdekken dat het probleem niet bij het model zelf lag, maar bij de ophaalfase waarin de informatie van het web werd verzameld. Bij andere experimenten kon R1's gedachtegang ons aanwijzingen geven als ze de informatie die we haar gaven niet kon analyseren, terwijl O1 ons een heel globaal idee gaf van hoe ze haar antwoord zou formuleren.

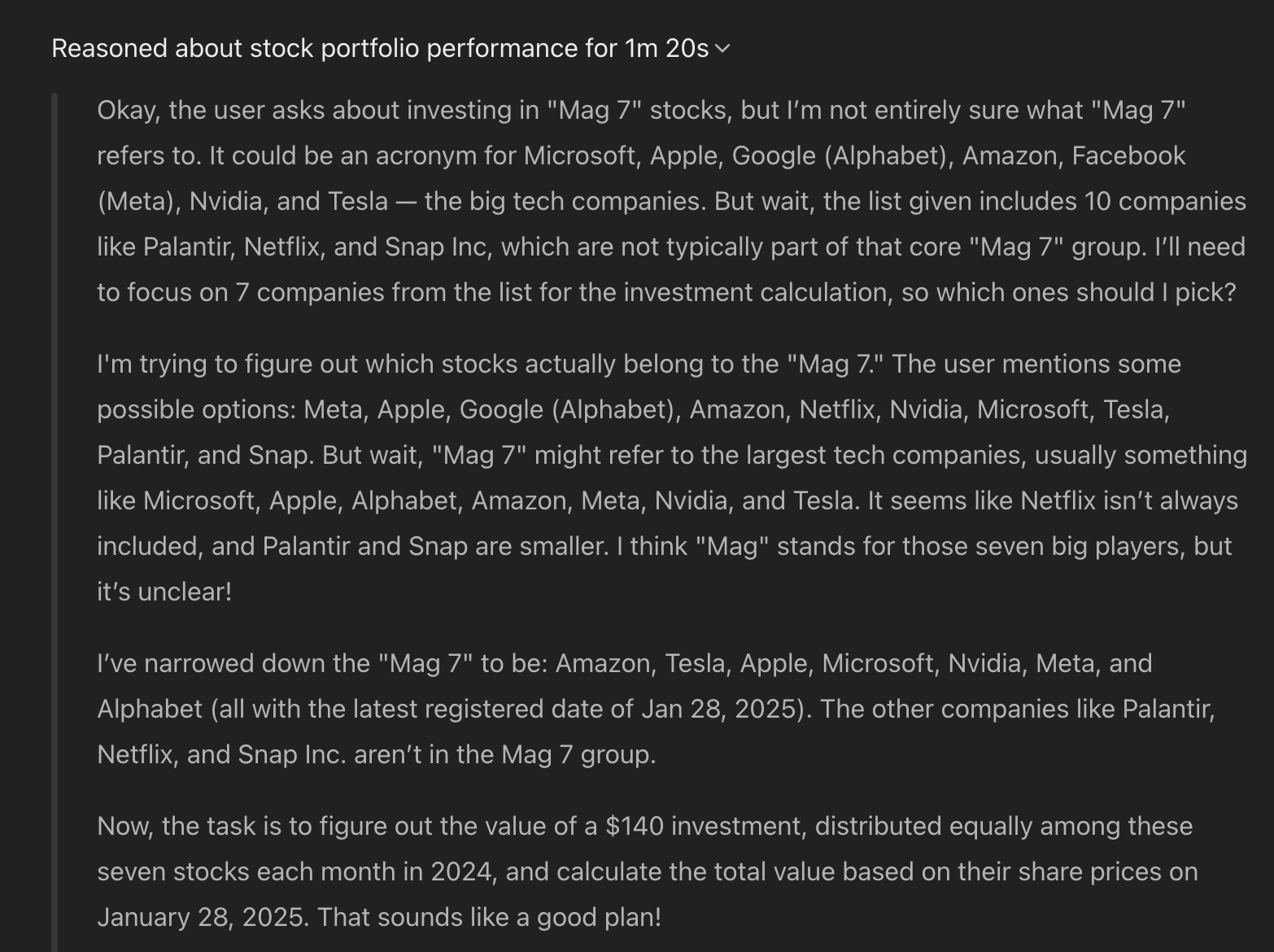

We hebben het nieuwe o3-mini-model getest in een variant op een eerder experiment dat we met de o1 deden. We hebben het model voorzien van een tekstbestand met verschillende aandelenkoersen van januari 2024 tot januari 2025. Het bestand was rommelig en ongeformatteerd; het bestond uit een mix van platte tekst en HTML-elementen. Vervolgens vroegen we het model om de waarde te berekenen van een portefeuille waarin op de eerste dag van elke maand van januari 140 tot en met januari 7 $ 2024 was belegd in Magnificent 2025-aandelen, gelijkmatig verdeeld over alle aandelen (we gebruikten de term "Magnificent 7" in de opdrachtprompt om het uitdagender te maken).

De o3-mini-ideeënserie was deze keer erg nuttig. Eerst bedacht het model wat Mag 7 was, filterde de data om alleen relevante aandelen over te houden (om het nog ingewikkelder te maken, voegden we ook enkele niet-Mag 7-aandelen toe aan de data), berekende het maandelijkse bedrag dat in elk aandeel geïnvesteerd moest worden en voerde de laatste berekeningen uit om het juiste antwoord te geven (de portefeuille zou ongeveer $ 2200 waard zijn op het laatste geregistreerde tijdstip in de data die we aan het model hebben doorgegeven).

Er zullen meer tests nodig zijn om de beperkingen van het nieuwe algoritme te bepalen, aangezien OpenAI nog veel details geheim houdt. Maar in onze eerste tests lijkt het nieuwe formaat bruikbaarder.

Wat betekent dit voor OpenAI?

Toen DeepSeek-R1 werd uitgebracht, had het drie duidelijke voordelen ten opzichte van de redeneermodellen van OpenAI: het was open source, goedkoop en transparant.

Sindsdien is OpenAI erin geslaagd deze kloof te dichten. Terwijl o1 $ 60 per miljoen geminde tokens kost, kost o3-mini slechts $ 4.40. Daarmee presteert o1-mini op veel benchmarks beter dan o1. R7 kost ongeveer $ 8 tot $ 1 per miljoen tokens die worden uitgegeven door Amerikaanse aanbieders. (DeepSeek biedt het R2.19-model aan voor $ XNUMX per miljoen tokens die op hun eigen servers worden gemined, maar veel organisaties kunnen dit niet gebruiken omdat het in China wordt gehost.)

Dankzij de nieuwe wijziging in de CoT-uitvoer heeft OpenAI het transparantieprobleem tot op zekere hoogte kunnen overwinnen.

Het is nog maar de vraag wat OpenAI gaat doen om zijn modellen open source te maken. Sinds de release is R1 al aangepast, vertakt en gehost door veel verschillende labs en bedrijven. Daardoor is het mogelijk het voorkeursdenkmodel voor bedrijven geworden. Sam Altman, CEO van OpenAI, gaf onlangs toe dat hij “aan de verkeerde kant van de geschiedenis” stond in het open source-debat. We moeten afwachten hoe dit besef zich in toekomstige versies van OpenAI manifesteert.

Reacties zijn gesloten.