Google's AI-fouten: hallucinerende idiomen en populaire gezegden

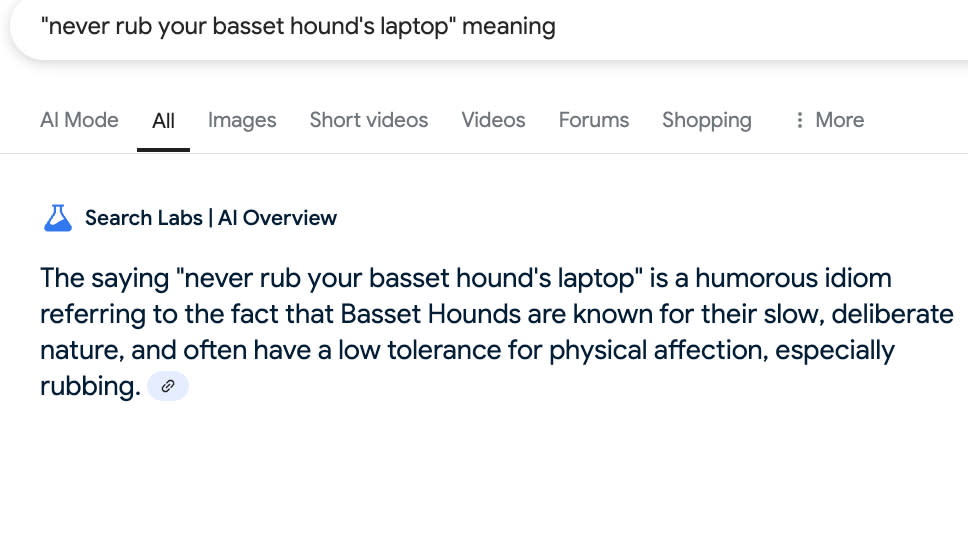

De nieuwste AI-trend is hilarisch. Een gebruiker ontdekte dat je een neppe zin in een Google-zoekopdracht kunt invoeren en daar het woord 'betekenis' aan kunt toevoegen. Vervolgens genereert de functie 'AI Overzicht' van Google op basis van uw verbeelding een betekenis voor die zin.

Historicus Greg Jenner zette deze golf in gang met een bericht op Bluesky Hij vroeg Google om de betekenis van de uitdrukking "Je kunt een das niet twee keer likken" uit te leggen. De AI-overzichtfunctie legt handig uit dat deze uitdrukking betekent dat je iemand niet een tweede keer voor de gek kunt houden als hij of zij al eens voor de gek is gehouden. Dat lijkt een redelijke verklaring, maar negeert het feit dat de term niet bestond voordat deze zoekopdracht wijdverbreid werd.

Sindsdien hebben mensen veel plezier gehad met het maken van de AI-overzichtfunctie, die termen als "een inktvis in een vaas zal niet kwaad over je spreken" uitlegt (Betekenis Iets buiten zijn natuurlijke omgeving zou blijkbaar geen schade kunnen veroorzaken) of “Je mag je hond wel meenemen naar het strand, maar je mag er niet mee naar Zwitserland zeilen” (En dat is het ookis, volgens de functie “AI Overzicht”, een vrij eenvoudige uitspraak over de moeilijkheid van internationale reizen met huisdieren.

Sindsdien hebben mensen veel plezier gehad met het maken van de AI-overzichtfunctie, die termen als "een inktvis in een vaas zal niet kwaad over je spreken" uitlegt (Betekenis Iets buiten zijn natuurlijke omgeving zou blijkbaar geen schade kunnen veroorzaken) of “Je mag je hond wel meenemen naar het strand, maar je mag er niet mee naar Zwitserland zeilen” (En dat is het ookis, volgens de functie “AI Overzicht”, een vrij eenvoudige uitspraak over de moeilijkheid van internationale reizen met huisdieren.

Dit werkt echter niet in alle gevallen, omdat sommige zinnen geen AI-overzichtresultaten opleveren. Cognitief wetenschapper Gary Marcus vertelde Bedraad"Het is zeer inconsistent, precies wat je van GenAI mag verwachten."

Jenner wijst erop dat dit weliswaar vermakelijk is, maar dat het ook wijst op een aantal potentiële risico's als er te veel wordt vertrouwd op door AI gegenereerde bronnen zoals 'AI Overview' voor informatie. كتب Jenner: "Het is een waarschuwingssignaal dat een van de belangrijkste functies van Googlen – het vermogen om een citaat te controleren, een bron te verifiëren of iets op te sporen waarvan men zich niet volledig bewust is – veel moeilijker zal worden als AI de voorkeur geeft aan statistische waarschijnlijkheid boven de feitelijke waarheid."

Dit is niet de eerste keer dat mensen wijzen op de beperkingen van de informatie die AI biedt, met name de AI Overzicht-functie. Toen het "AI Overzicht" werd uitgebracht, werd daarin de beruchte suggestie gedaan dat mensen één kleine steen per dag moesten eten en dat ze lijm op hun pizza konden smeren. Deze specifieke antwoorden werden echter snel verwijderd.

Sindsdien heeft Google aangegeven dat de meeste AI-overzichten nuttige en feitelijke informatie verschaffen en dat het feedback over zijn AI-product blijft verzamelen.

Laat dit voorlopig dienen als herinnering om de informatie die in het vak 'AI-overzicht' bovenaan de Google-resultaten verschijnt, nog eens goed te controleren, aangezien deze mogelijk niet nauwkeurig is.

Reacties zijn gesloten.